Un peu d'épistémologie

Préambule

J'ai pris la décision d'écrire un chapitre d'épistémologie relativement tôt durant ma thèse. Il est vrai que cela peut surprendre dans une thèse dont le sujet est "réseau de régulation génique chez E. coli". Je ressens donc le besoin de me justifier en 3 points. Si vous ne comprenez pas cette justification ou que vous ne savez pas ce qu'est l'épistémologie alors sautez le préambule et lisez directement la suite.

- L'institution positiviste qui m'emploie me "demande" de travailler sur les réseaux de

régulation génique. Or ceci est légèrement paradoxal car il suffit de "gratter" un petit peu

pour se rendre compte que la notion de réseau, de système est la chasse-gardé des épistémologies

constructivistes concurrentes. Ces épistémologies défendent justement l'idée qu'il faut décloisonner

les sciences et réfléchir au système complexe que les sciences représentent.

"Il ne faut pas éliminer l'hypothèse d'un néo-obscurantisme généralisé, produit par le mouvement même des spécialisations, où le spécialiste lui-même devient ignare de tout ce qui ne concerne pas sa discipline, où le non-spécialiste renonce d'avance à toute possibilité de réfléchir sur le monde, la vie, la société, laissant ce soin aux scientifiques, lesquels n'en ont ni le temps, ni les moyens conceptuels. Situation paradoxale que celle où le développement de la connaissance instaure la résignation à l'ignorance et où le développement de la science est, en même temps, celui de l'inconscience." 1

Je me revendique donc de l'héritage des épistémologies constructivistes et me place sous leur protection. En effet, ce sont ces dernières qui me permettent de décloisonner mon sujet de thèse en l'envisageant sous des angles variés.

- Il me semble que, dans d'autres domaines de la biologie que le mien, par exemple en physiologie, en neurologie ou en écologie, les expériences sont lourdes à mettre en place. Elles sont aussi plus chères et prennent plus de temps (semaines, mois). Au final, le nombre de cycles hypothèse--expérience--interprétation qu'un chercheur pourra mener sera limité. En microbiologie, en particulier avec E. coli, il est possible de faire un très grand nombre de cycles hypothèse--expérience--interprétation (des centaines, milliers) car la bactérie pousse très vite (pré-culture en une nuit) et l'expérience en elle-même ne coûte pas cher. Ce grand nombre de cycles permet de se forger une image intuitive du fonctionnement de la bactérie. Mais il permet en outre d'évaluer (en essayant de prendre du recul) comment avance "sa" science et si les découvertes produites sont fonction de l'application stricte de la méthode scientifique. En ce qui me concerne, je crains que la réponse soit clairement non et ce, même si vérifiabilité et reproductibilité ont joué un rôle incontestable.

- Je me suis heurté, dans mon environnement scientifique, à un vif rejet lorsque je défendais les positions suivantes:

- la méthode scientifique n'a pas de base solide et toute démonstration contient une part de persuasion.

- la science est impure car se cache derrière elle un scientifique qui est avant tout un homme. Heureusement que ces impuretés sont là sinon la science ne pourrait pas avancer.

- La science n'avance pas seulement selon le schéma hypothèse--expérience--résultat. En biologie, les systèmes expérimentaux n'aident pas seulement à répondre aux questions, ils aident à la générer.

Etant un piètre avocat, je perd systématiquement tout débat. Pourtant mes arguments proviennent des idées d'épistémologues et sociologues reconnus mais elles restent, il me semble, relativement mal acceptées/connues par les scientifiques.

"Ainsi nul n'est plus désarmé que le scientifique pour penser sa science. La question "qu'est-ce que la science ?" est la seule qui n'ait encore aucune réponse scientifique. C'est pourquoi s'impose plus que jamais la nécessité d'une auto connaissance de la connaissance scientifique. Celle-ci doit faire partie de toute politique de la science, comme de la discipline mentale du scientifique". 2

Or comme j'ai la conviction que notre rôle (de scientifique mais aussi d'humain) consiste à propager les idées/les constructions cognitives/les pistes auxquelles on croit, je m'y emploie à l'écrit à défaut de réussir à l'oral.

Malgré mon prosélytisme marqué, je trouve normal que les attaques contre "la sacro-sainte méthode scientifique positiviste" peinent à envahir la sphère scientifique (les laboratoires). En effet, pendant l'éducation, on apprend aux élèves des règles, des méthodes, de la rigueur, on leur laisse entendre que les mathématiques sont disciplines reines car plus rigoureuses. Puis arrive un anarchiste, Paul Feyerabend, dans les années 70 qui propose son provoquant:

"Étant donné un but, l' "a-méthode" [absence de méthode] de l'anarchiste [épistémologique] a une plus grande chance de réussir que n'importe quel ensemble de critères, règles ou prescriptions bien définis" 3

Comment voulez-vous expliquer à ces élèves (devenus chercheurs) que, finalement, l'anarchiste n'a peut être pas tort: l'absence de méthode vaut mieux que tout. La pilule passe mal et c'est normal.

Après cette justification un peu longue, voici mon plan. J'essaierai, dans ce chapitre, de mettre en perspective quelques résultats et idées qui ont été obtenus en épistémologie au cours du siècle dernier. Il s'agit principalement des travaux de Karl Popper, Thomas Kuhn, Paul Feyerabend, Edgar Morin et Jean louis le Moigne. Plus surprenant, j'ai trouvé chez Nietzsche des idées d'épistémologie très avant-gardistes. Je ne me souviens pas avoir lu d'ouvrages de scientifiques ou épistémologues citant explicitement son travail.

Dans les chapitres qui suivent (plus personnelles), je prônerai le décloisonnement du système de publication actuel et je montrerai le rôle caché des arbitrages (falsification) en science. Puis je marcherai sur des oeufs en analysant la place de la discipline en science et je déconstruirai la critique. Enfin, je proposerai une réflexion personnelle sur la question "qu'est-ce que la science ? ".

Le socle de base n'est pas sûr

Les épistémologies positivistes

Savez-vous ce qu'est l'épistémologie ?

L'épistémologie est le domaine de la philosophie des sciences qui étudie les sciences et la connaissance. Elle cherche à comprendre et à décrire les règles de fonctionnement de la science, par exemple la fameuse méthode scientifique. Mais plus profondément, elle cherche à percer à jour les règles qui sous tendent l'acte de "connaitre".

Savez-vous ce qu'est l'épistémologie positiviste ?

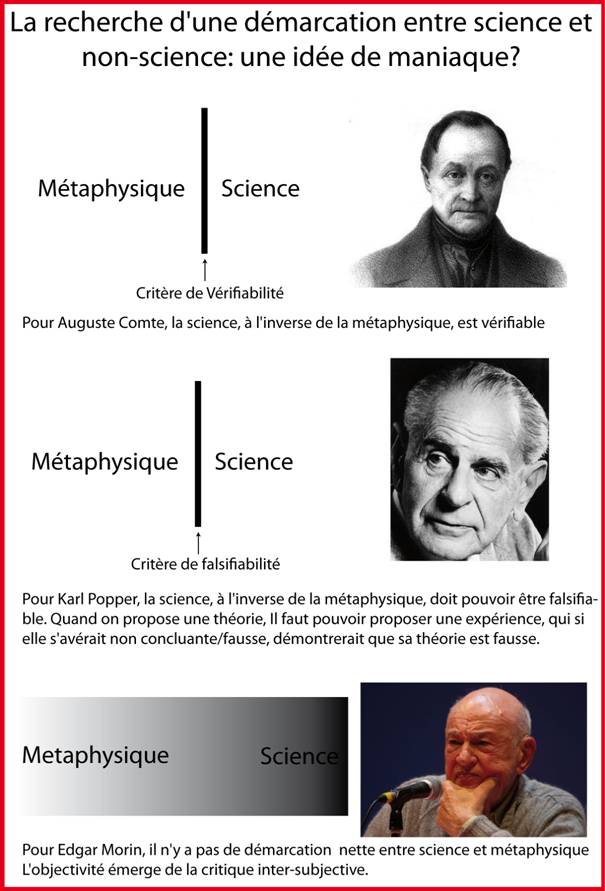

L'épistémologie positiviste est l'épistémologie dominante et donc institutionnelle. Elle explique grâce au principe de "vérifiabilité" le fait que, au cours des millénaires, la science progresse alors que, au contraire, les religions stagnent. On utilise ce principe en laboratoire tous les jours. Si vos expériences ne sont pas vérifiables, l'institution ne vous permettra pas de prétendre qu'elles s'inscrivent dans le cadre de la démarche scientifique. Au cours du 20ème siècle, Karl Popper a proposé une amélioration du principe de "vérifiabilité" : le principe de "falsifiabilité". Karl Popper part du constat que l'on ne peut pas réellement "vérifier" ce qui est vrai. Selon lui, lorsque qu'un scientifique propose une théorie, il faut qu'il soit en mesure de proposer une expérience qui, si elle s'avérait non concluante/fausse, démontrerait que sa théorie est fausse. Voici un exemple: je propose la théorie suivante: La bactérie E. coli ne pousse pas sur une gélose constituée de 70% d'éthanol. Ensuite je vous propose de "réfuter" ma théorie à l'aide du principe de falsification "si vous préparez une gélose constituée de 70% d'éthanol puis inoculez dessus des bactéries E. coli et que ces dernières réussissent à former des colonies, alors ma théorie est fausse ". Quelles que soient la théorie et l'expérience, l'énoncé devra toujours être structuré de la même manière: Si [mon expérience ne fonctionne pas], alors ma théorie est fausse. Ce principe permet d'écarter des théories pseudo-scientifiques capables d'expliquer tout et son contraire. Il faut noter que Karl Popper n'était pas un positiviste (il semble qu'il en rigole lui-même en parlant de "la légende de Popper"). Cependant, le fait de proposer un principe opérant une démarcation entre science et non science (c'est sa plus grande erreur) a contribué à le faire considérer par beaucoup comme un positiviste.

Mais ces principes de vérifiabilité et falsifiabilité ne correspondent pas aux fondements de l'épistémologie positiviste. Jean-Louis le Moigne4 identifie deux hypothèses aux fondements:

-

L'hypothèse ontologique: Elle nous est si familière, à nous scientifiques, qu'elle n'est pas toujours perçue comme une hypothèse épistémologique.

"La réalité essentielle de la réalité existentielle: la connaissance que constitue progressivement la science est la connaissance de la réalité, une réalité postulée indépendante des observateurs qui la décrivent (même si leurs descriptions n'en sont pas indépendantes)"

-

hypothèse déterministe:

"Il existe quelque forme de détermination interne propre à la réalité connaissable, détermination elle-même susceptible d'être connue. Sous sa forme la plus familière, le déterminisme est un causalisme [...]. Ce n'est pas parce que les lois déterminant la réalité ne peuvent être établies et donc connues du fait de l'incomplétude de nos instruments de mesure (sensibilité aux conditions initiales, principe d'incertitude d'Heisenberg) que ces lois n'existent pas"

A ces deux hypothèses, Jean-Louis le Moigne5 ajoute deux méthodes qui en découlent:

- le principe de modélisation analytique qui consiste à décomposer en parties, en petites briques élémentaires. On se souviendra du deuxième précepte du discours de la méthode qui propose "de diviser chacune des difficultés [...] en autant de parcelles qu'il se pourrait et qu'il serait requis pour les mieux résoudre" 6

- le principe de raison suffisante (qui découle du déterminisme). Ce principe postule l'existence des causes mais également l'équivalence entre cause et effet: "Si A est cause de B, B ne peut être causé que par A et donc A est la raison suffisante ou l'explication certaine de B ". Cette formulation de raison suffisante nous vient de Leibniz "rien jamais n'arrive sans qu'il n'y ait une cause ou du moins un raison déterminante". Ce principe ajoute subrepticement une hypothèse forte sur la nature du raisonnement positif ou de l'explication: celle de la naturalité de la logique déductive (formelle). Cette dernière acquiert un statut disciplinaire privilégié dans le champ des connaissances car elle assure que l'ordonnancement (les longues chaines de causes à effet) est naturel ou réel et donc rend indiscutablement compte de la réalité.

Jusque-là, si vous n'aviez jamais entendu parler d'épistémologie, sachez qu'il est fort probable que vous travailliez, dans votre laboratoire, sous le régime du positivisme et de sa logique déductive. Cela n'est pas un problème car l'épistémologie positiviste a fait ses preuves. Cependant, il est important de garder à l'esprit que les fondements de cette épistémologie (comme de toutes autres d'ailleurs) sont des hypothèses. C'est-à-dire des énoncés qui n'ont pas pu passer l'examen de la vérifiabilité. Autrement dit le socle, le fondement de notre méthode n'est pas sûr. Il dépend de ces hypothèses qui dépendent elles-mêmes de nos perceptions sensorielles. Il est temps maintenant de passer au deuxième type d'épistémologie que je souhaite décrire.

Les épistémologies constructivistes

Ces épistémologies sont également basées sur des hypothèses. Autrement dit le socle n'est pas plus sûr mais il ne l'est pas moins. Les quelques paragraphes qui suivent sont trop empruntés à l'ouvrage de Jean-louis le Moigne pour que je puisse m'en attribuer la paternité. Mon travail consiste en une synthèse, une reconstruction rapportant et remaniant les phrases et définitions les plus limpides que l'auteur ait écrites. Mon but affiché est de tenter de faire "saisir" au lecteur, en quelques lignes, des concepts fondamentaux. Pourtant, j'ai bien conscience que ma synthèse est difficile d'accès et demande un effort d'abstraction important. Je n'ai pas réussi à la rendre plus claire. Je renvoie donc le lecteur insatisfait vers que le "que-sais-je ?" limpide de Jean-louis le Moigne. Pour éviter toute lourdeur, je n'utiliserai pas les guillemets mais placerai les paragraphes remaniés en italique.

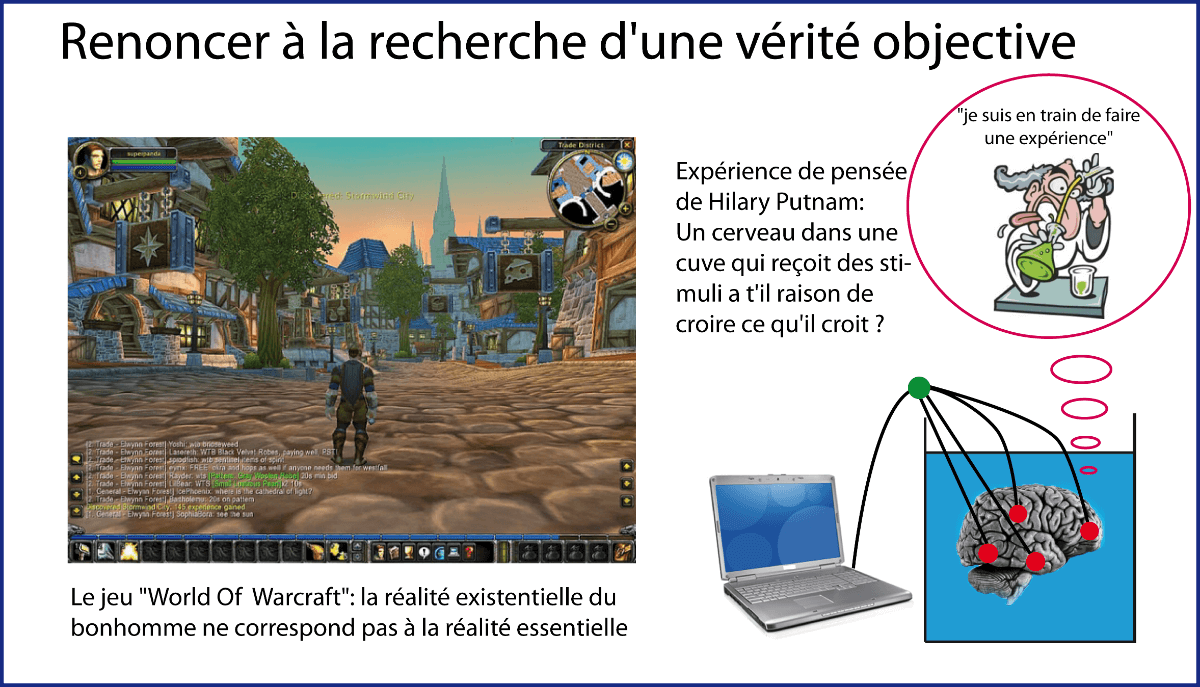

On ne peut pas exclure l'hypothèse que l'on vive dans une sorte de rêve, de matrice, de jeu video. Dés lors, notre accès à la réalité est limité. Par exemple, le sol sur lequel le bonhomme d'un jeu vidéo marche n'existe pas réellement dans notre réalité, il est virtuel. Pour ce bonhomme, au contraire, le sol a une réalité physique puisqu'il ressent un "phénomène" qui le maintient et l'empêche de tomber.

J'ouvre ici une petite parenthèse réservée aux théoriciens/logiciens. Voici mon problème :

Soit un scientifique "à la pensée libre" (c'est-à-dire non créé par le programmeur) se retrouvant dans un jeu vidéo (un programme créé de toute pièce avec des 0 et des 1). Via l'utilisation illimitée de la raison et de l'expérience, le scientifique peut-il:

- reconstituer toutes les lois du monde virtuel dans lequel il vit ?

- reconstituer toutes ces lois et déterminer, par ingénierie inverse, le code source du programme ?

- reconstituer les lois + le code source du programme + les lois de notre monde réel ?

Autrement dit, existe-t-il une limite infranchissable entre les lois (issues de phénomènes dits virtuels) et le code source? Si non, existe-t-il alors une limite infranchissable entre le code source et nos lois (issues de phénomènes dits réels )? Si vous disposez d'éléments de réponse ou d'une démonstration, n'hésitez pas à me contacter. Fin de la parenthèse.

Autrement dit, le bonhomme ne peut pas exclure l'existence d'un réel connaissable qui lui serait étranger. Ainsi, la connaissance qu'il peut construire du réel est celle de sa propre expérience du réel. Il y a une renonciation consciente à la valeur de vérité objective qui a sans doute longtemps retardé l'acceptation par l'épistémologie institutionnelle. La réalité connaissable doit pouvoir être cognitivement construite. Par conséquent, l'hypothèse relative à la construction de la connaissance ne fait plus appel à une norme du "vrai" mais à une norme de "faisabilité": "Entre l'être et le connaître, le faire"7. Les constructions cognitives sont d'ailleurs familières depuis longtemps aux mathématiciens qui font exister ces objets réels par construction que sont les figures géométriques, les nombres ou les opérateurs symboliques.

On a toujours cherché des explications quand c'était des représentations qu'on pouvait seulement essayer d'inventer. Le sujet connaissant ne représente pas des choses mais des opérations (ou des interactions) et la connaissance qu'il en construit par des représentations est elle-même opératoire ou active. La représentation active d'un phénomène connaissable transforme récursivement la connaissance que nous en avons, laquelle, à son tour... "En changeant ce qu'il connait du monde, l'homme change le monde qu'il connaît. Et en changeant le monde dans lequel il vit, l'homme se change lui-même"8. La connaissance que construit le sujet par son expérience organise simultanément le mode de construction de cette connaissance ou son intelligence. On ne peut donc plus dés lors séparer la connaissance de l'intelligence (ou cognition) qui la produit et il nous faut entendre la connaissance par le processus qui la forme autant que comme le résultat de ce processus de formation. L'intelligence organise le monde en s'organisant elle-même.

Jean-Louis le Moigne identifie deux hypothèses à la base des connaissances constructibles:

- L'hypothèse phénoménologique: le réel connaissable est un réel phénoménologique, celui que le sujet expérimente. Ce dernier ne connait pas de chose en soi (hypothèse ontologique) mais il connait l'acte par lequel il perçoit l'interaction entre les choses.

- L'hypothèse téléologique: En attribuant au sujet connaissant le rôle décisif dans la construction de la connaissance, l'hypothèse phénoménologique oblige en quelque sorte à prendre en compte l'intentionnalité ou les finalités de ce sujet connaissant. Cette hypothèse téléologique n'est pas encore très volontiers acceptée par l'épistémologie institutionnelle positiviste. Or comme l'avait remarqué H. Von Foerster, à la réponse à la question "pourquoi ", on peut tout aussi bien s'exprimer en termes de "à fin de" qu'en termes de "parce que ". Ainsi, connaitre en termes de fins plausibles constitue un mode de connaissance au moins aussi bien raisonné que de connaitre en termes de causes probables.

On peut donc résumer ainsi le paradigme constructiviste comme étant l'expression téléologique d'expériences cognitives s'articulant systémiquement dans leur contexte et susceptibles d'être manipulés (ou computés) selon des procédures cognitives reproductibles. La valeur socioculturelle du paradigme constructiviste pourrait aider à organiser et reconnaitre comme vraie science, les sciences de l'artificiel, la où on retrouve une téléologie comme les sciences des systèmes (informatique, science économique par exemple). Le but étant de leurs donner un appui épistémologique pour les aider à sortir du cadre du charlatanisme. C'est la conception d'une discipline scientifique par leur projet plutôt que par leur objet.

J'aimerais revenir sur les constructions cognitives qui font exister les figures géométriques, les nombres ou les operateurs symboliques. Le point important c'est que ces constructions cognitives sont "faisables". Or, la compréhension du fonctionnement des réseaux de régulation intracellulaires (intra-neuronal) et extracellulaire (réseau de neurones) peut conduire, dans le futur, à un accroissement de capacités computationnelles/cognitives. Cela pourrait potentiellement élargir le "faisable" et permettre la construction de nouveaux objets mathématiques qui n'étaient jusqu'alors pas "pensables", pas "constructibles ". Les avancées et les futures "ruptures/révolutions" en mathématiques pures pourraient provenir non plus de l'application des règles de la logique formelle mais par l'élargissement, par des méthodes issues de la biologie, de nos capacités cognitives. J'utilise cet exemple pour illustrer le phénomène de récursivité dans l'élaboration de la connaissance: le cerveau élabore par construction une connaissance (par exemple en biologie, en mathématique) capable de modifier, d'améliorer le cerveau. Ce dernier produira alors une nouvelle connaissance par accroissement de "faisabilité", etc...

La structure des avancées scientifiques

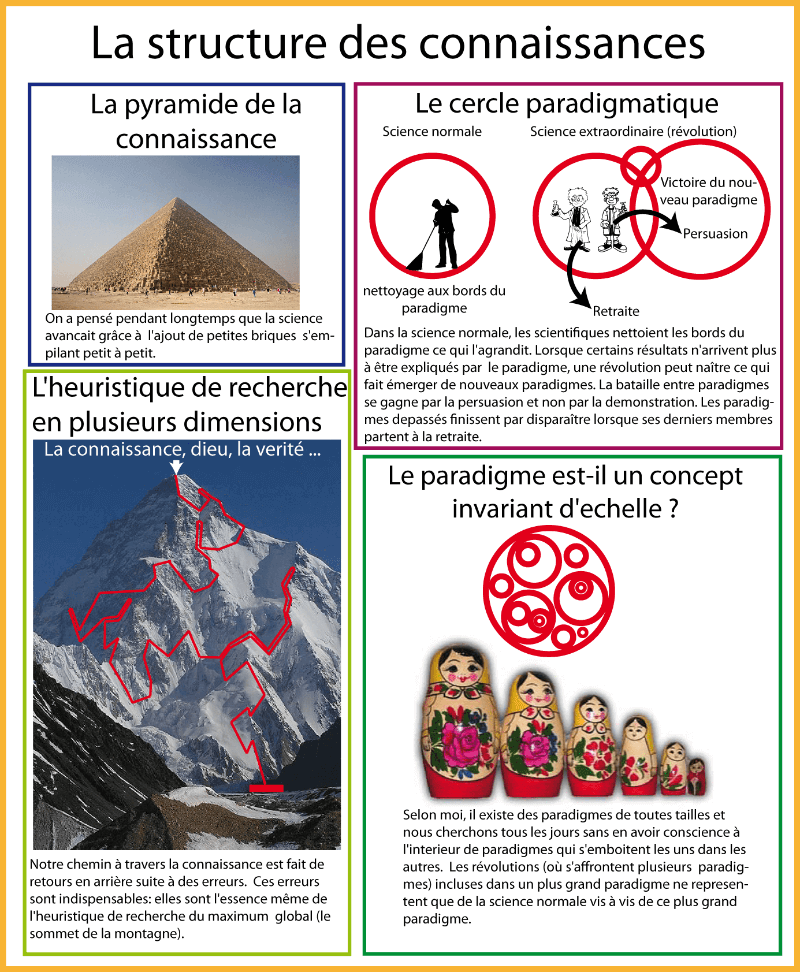

La pyramide

Nous avons vu dans cette première partie qu'il existe une incertitude sur les fondements de la science. Cependant, nous avons le sentiment qu'il y a, au cours de l'histoire, une pente positive du progrès/des connaissances et ce, par opposition à la pente des connaissances issues des religions qui semble, elle, rester constante9. Comme le dit Bachelard, "L'histoire des sciences est la plus irréversible de toutes les histoires ". Ainsi, on se représente les connaissances comme une pyramide formée par l'ajout au fur et à mesure de briques vérifiables. L'image de la pyramide est robuste chez les scientifiques car c'est comme cela que la science est enseignée durant l'apprentissage primaire et secondaire. Mais c'est une image qui rend mal compte du développement réel des sciences car il existe des ruptures brutales qui provoquent des avancées majeures: par exemple l'arrivée de la relativité générale en remplacement de la mécanique Newtonienne. Je vais donc maintenant substituer l'image de la pyramide par celle du cercle.

Le cercle

Dans son ouvrage La Structure des révolutions scientifiques publié en 196210, Thomas Kuhn s'efforce de montrer pourquoi le développement scientifique n'est pas un processus linéaire/ cumulatif. En effet, selon lui, la science progresse de manière fondamentalement discontinue, c'est-à-dire non par accumulation mais par rupture. L'évolution des idées scientifiques s'organise en deux grandes phases alternatives, qualifiées de science normale et de science extraordinaire. La phase de science normale est la phase usuelle, celle qui constitue en durée l'essentiel de l'histoire des sciences. Un groupe de scientifique adhère massivement à un paradigme qui par ses "accomplissements scientifiques passés" et sa logique, fournit "le point de départ d'autres travaux ". Un paradigme est une représentation du monde qui repose sur une base définie (une forme de rail de pensée). C'est l'ensemble des croyances, des techniques, des règles admises et intériorisées comme "normes" qui sont partagées par les membres d'un groupe de scientifique, au cours d'une période de consensus théorique. Je demande au lecteur de se représenter le paradigme comme un cercle. La science qui est y faite est essentiellement prédictive: les scientifiques testent inlassablement le paradigme en concevant de nouvelles énigmes de manière à le renforcer (à élargir le cercle). Une bonne énigme doit être suffisamment difficile pour être intéressante mais suffisamment simple pour être résolvable et ainsi permettre aux scientifiques de montrer leur habilité et leur ingéniosité: "La conviction que, si seulement il est assez habile, il réussira à résoudre une énigme que personne encore n'a résolue, ou résolue aussi bien"11. Les scientifiques normalisent tout l'espace à l'intérieur du cercle par des exercices de nettoyage, de sorte à faire entrer "la nature dans leur boîte". Les problèmes qui y sont résolus sont de taille très limités. Mais inévitablement, des anomalies apparaissent, généralement dénoncées par des théories concurrentes. La plupart d'entre elles seront expédiées par des raisonnements ad-hoc pour sauver le paradigme. Mais si ces anomalies sont prises en considération, alors une crise s'installe et c'est le début d'une révolution scientifique: on passe dans la phase du régime extraordinaire. On voit alors apparaitre de nouvelles théories (des nouveaux petits cercles) cherchant à expliquer les anomalies et à remplacer le paradigme mis en défaut. Ces théories sont donc candidates au titre de nouveau paradigme. Bien sûr, durant la crise, de nombreux scientifiques (ceux qu'une carrière féconde avait profondément engagés dans l'ancien paradigme) gardent "la certitude que l'ancien paradigme parviendra [finalement] à résoudre tous les problèmes "12. Ces résistances sont utiles car elles "empêchent que le paradigme soit trop facilement renversé " ce qui évite que "les scientifiques [soient] dérangés sans raison "13. Le processus de révolution n'est pas immédiat. Il progresse par des prises de positions successives de la part des groupes scientifiques confrontés à une crise. Lorsque ces différents groupes se rallient finalement à une nouvelle théorie consensuelle, celle-ci devient un paradigme et la révolution est achevée. La science normale, prédictive, réapparait et les scientifiques sont chargés de nettoyer et d'élargir le cercle jusqu'à ce que de nouvelles anomalies apparaissent.

Les poupées russes

Le schéma des cercles souffre selon moi d'une lacune (je ne sais pas si la critique qui suit a déjà été opposée à Thomas Kuhn mais cela ne m'étonnerait pas). En effet, j'imagine plutôt une structure invariante d'échelle (type poupées russes): Autrement dit il existerait selon moi une multitude de cercles dans le cercle. Par ses expériences, tout scientifique teste et met en danger chaque jour des paradigmes de tailles différentes. Comme le dit Jacques Monod:

"En confrontant systématiquement la logique et l'expérience, selon la méthode scientifique, c'est en fait toute l'expérience de [nos] ancêtres [nos prédécesseurs] que nous confrontons avec l'expérience actuelle"14

Un étudiant, par exemple, peut être amené à déconstruire une petit brique de l'étudiant précédent en repérant un artefact ou une anomalie passé jusque là inaperçu. Et il est fort possible qu'il rencontre la fameuse résistance de Kuhn, d'autant plus si "la brique" a été publiée. Bien sûr, déconstruire le "micro-paradigme" d'un chercheur est un processus courant alors que déconstruire le paradigme de quelques milliers de chercheurs est beaucoup plus rare pour des raisons statistiques évidentes: il est courant qu'un chercheur se trompe et beaucoup moins courant que 1000 chercheurs se trompent. C'est cette rareté qui rend les gros paradigmes beaucoup plus visibles, plus médiatiques. Notez enfin que, du point de vue d'un paradigme donné (un cercle), tous les paradigmes du dessous (inscrits dans ce cercle) représentent la science normale.

La montagne

Une notion essentielle qui n'est pas captée distinctement par l'image des cercles paradigmatiques c'est la notion d'erreur. Pour intégrer ces erreurs, il faut imaginer une heuristique à la recherche d'un optimum global. L'image de la montagne aide à se représenter le processus. Imaginez un point de départ (tout en bas de la montagne) et un objectif à atteindre: le sommet de la montagne qui symbolise au choix, la verité, la connaissance, dieu, la réalité connaissable etc... Les scientifiques cherchent, depuis des milliers d'années, le chemin, la voie d'escalade à travers l'immense falaise qui les mènera au sommet. Ils avancent souvent en suivant la voie la plus simple, la plus intuitive, là où les expériences sont facilement reproductibles et donc faciles. Mais inexorablement les difficultés augmentent, les expériences se compliquent, les phénomènes ne se laissent pas approcher sans douleur. Sans parler de la multitude de biais cognitifs qui les oriente dans la mauvaise direction et qui nécessite une grande énergie pour être dépassée. Certains scientifiques sont chargés d'avancer tout droit, coûte que coûte, centimètre par centimètre, d'autres explorent les environs directs: ils redescendent un peu, quelques mètres, dizaines de mètre à la recherche d'un passage plus simple pour effectuer une percée. Enfin certains, mais ils sont rares, sont capables de redescendre très bas, presque tout en bas pour choisir une autre voie qui mènera plus haut.

Redescendre c'est reconnaitre que le chemin parcouru peut potentiellement mener à une impasse. Ce n'est pas le constat d'un échec mais bien le processus normal de recherche de toutes heuristiques. Ainsi ces erreurs (qui orientent dans la mauvaise direction en devenant des dogmes) ainsi que ce qui les corrige (les retours en arrière, les déviations) sont le fonctionnement normal de la science et donc les conditions du progrès. Ces erreurs font intrinsèquement parties de l'heuristique de recherche: elles en sont l'essence même. Georges Canguilhem a bien identifié le processus de redescente (l'effort violent dont il parle):

"Il est instructif de constater combien plus et mieux que leur continuateurs et commentateurs, les fondateurs de théories nouvelles se sont rendus compte des faiblesses et des insuffisances de leurs systèmes. Leurs réserves sont ensuite oubliées ce qui pour eux était hypothèse devient dogme de plus en plus intangible à mesure qu'on s'éloigne davantage des origines et un effort violent devient nécessaire pour s'en délivrer lorsque l'expérience vient démentir les conséquences plus ou moins lointaines d'idées dont on avait oublié le caractère provisoire et précaire." 15

La déconstruction du critère de falsifiabilité

Paul Feyerabend est un philosophe des sciences qui a écrit un ouvrage (dont je conseille vivement la lecture) Contre la méthode publié en 1975. Il se définit comme un épistémologue anarchiste. Il nie l'existence de règles méthodologiques universelles, nie l'existence d'une démarcation entre science et non science et donc nie que le critère de falsifiabilité de Popper puisse opérer cette démarcation. Selon lui, en science, "tout est bon".

Feyerabend a vivement critiqué l'attitude consistant à juger la qualité des théories scientifiques (prédictions) en les comparants avec des résultats expérimentaux (observations). Son analyse de "l'argument de la tour" est particulièrement convaincante. Cet argument constituait l'objection majeure à la théorie tentant de démontrer que la terre tourne. Beaucoup pensaient, à l'époque de Copernic, que le fait qu'une pierre tombant d'une tour atterrisse juste devant la tour prouve que la terre est immobile. En effet, ils pensaient que si la terre effectuait une rotation pendant que la pierre tombait, celle-ci aurait atterri derrière la tour. Si la terre tournait, les objets ne tomberaient pas à la verticale mais en diagonale selon eux. Or comme cela ne se produisait pas, cela prouvait l'immobilité de la terre.

Je ne vais pas paraphraser plus longtemps la pensée de Feyerabend. Je laisse découvrir à mon lecteur un avant goût de la clarté, de la profondeur et de l'acidité de son texte via quelques citations choisies.

L'évidence est viciée

"La prise en compte de tous ces éléments: terme d'observation, noyau de facultés sensorielles, sciences auxiliaires, spéculations à l'arrière plan, suggère qu'une théorie peut être incompatible avec l'évidence empirique non parce qu'elle est incorrecte, mais parce que c'est l'évidence même qui est viciée" 16

Les faits sont impurs

"Les théories sont testées et éventuellement réfutées par des faits. Les faits contiennent des composantes idéologiques, des conceptions plus anciennes qu'on a perdues de vue ou qui n'ont peut être jamais été formulées de façon explicite. De telles composantes sont hautement suspectes". 17

Aucune théorie ne devrait être rejetée

"D'après nos résultats actuels, presque aucune théorie n'est compatible avec les faits. Exiger de n'admettre que les théories compatibles avec les faits, cela nous laisse à nouveau sans aucune théorie (il n'y a pas une seule théorie qui ne soit en difficulté d'une manière ou d'une autre) [...] La bonne méthode ne doit contenir aucune règle qui nous oblige à choisir entre des théories sur la base de la falsification ; bien plutôt ses règles doivent nous permettre de choisir entre des théories que nous avons déjà testées et qui sont réfutées [...]. Non seulement les faits et les théories sont en constant désaccord, mais ils ne sont jamais aussi nettement séparés que nous voulons le croire. Les règles de méthodologie parlent de "théories ", d' "observations" et de "résultats expérimentaux" comme s'il s'agissait d'objets précis, bien définis dont les propriétés seraient faciles à évaluer et seraient compris de la même manière par tous les scientifiques. Or le matériel qui est réellement mis à disposition d'un scientifique: ses lois, ses résultats expérimentaux, ses techniques mathématiques, ses préjugés épistémologiques [...] est indéterminé de bien des manières, ambigu, et jamais complètement séparé du contexte historique." 18

L'attaque ironique contre les positivistes/rationalistes

"Développez vos idées de façon qu'elles puissent être critiquées ; attaquez les impitoyablement ; n'essayez pas de les protéger, exhibez leurs points faibles ; éliminez les aussitôt que ces points faibles sont devenus manifestes -- ce sont là quelques règles mises en avant par nos rationalistes critiques" 19

Ainsi Feyerabend argumente l'idée que toute expérience que nous faisons peut être conceptualisée de différentes manières et qu'aucune conceptualisation est dénuée d'hypothèses théoriques. Cette thèse de "dépendance à la théorie" de toutes interprétations issues d'expériences a été poussée à l'extrême par le sociologue des sciences Harry Collins dans son ouvrage Tout ce que vous devriez savoir sur la science. Il y met en évidence ce qu'il appelle "la régression de l'expérimentateur". Cette régression apparait quand une théorie peut seulement être établie/vérifiée par la mise en place d'une expérience technique. Pour cela évidemment, la technique doit être fiable. Or le jugement qui consiste à savoir si la technique est fiable dépend des résultats. Or ces résultat seront vérifiés/validés/interprétés grâce à la théorie elle-même ce qui génère une boucle de dépendance. L'expérience célèbre de Sir Arthur Eddington avait pour but de confirmer la théorie de la relativité générale d'Einstein. L'expérience consistait à mesurer la déviation que la lumière d'une étoile subit à cause de la gravitation exercée par la masse du Soleil. Cette déviation étant une des prévisions découlant de la théorie d'Einstein. Or ce qu'Harry Collins montre c'est que l'interprétation des observations (des photos de l'étoile) dépendait de la théorie d'Einstein.

"L'observation et la prédiction étaient liées en un cercle de confirmation mutuelle et non pas indépendantes l'une de l'autre, comme on devrait s'y attendre selon l'idée conventionnelle d'une vérification expérimentale [...] la réalité était donc qu'on était d'accord pour s'accorder" 20

Il apparait donc aux yeux du philosophe et du sociologue que le processus classique de comparaison prédiction--observation n'est pas aussi fiable/innocent/sûr qu'il n'y parait.

Apologie de l'irrationalité

Revenons maintenant aux combats qui opposent les paradigmes de Thomas Kuhn. Ce dernier se rend compte que la confrontation des paradigmes se joue sur un terrain qui n'est que partiellement rationnel. Les opinions des scientifiques, leurs croyances et leurs visions du monde influent sur le fonctionnement de la science qui prend une dimension spéculative souvent doublée de questionnements métaphysiques. Pour Kuhn:

"les adeptes de paradigmes concurrents ne s'entendent jamais complètement [...] leur discussion est inévitablement un dialogue de sourds. Chacun peut espérer convertir l'autre à sa conception de la science et de ses problèmes, aucun ne peut espérer prouver son point de vue. La concurrence entre paradigmes n'est pas le genre de bataille qui puisse se gagner avec des preuves" . 21

"Les deux groupes voient des choses différentes quand ils regardent dans la même direction à partir du même point" 22

"pour comprendre comment se font les révolutions scientifiques, il nous faudra étudier [...] les techniques de persuasion par discussion qui jouent un rôle au sein de ces groupes assez particuliers qui constituent le monde des sciences" 23

Ca y est le mot est prononcé: la lutte entre paradigmes se gagne par la persuasion plutôt que par la démonstration. Mais Kuhn rechigne à aller au bout de cette idée. Il souhaite se démarquer de tout relativisme potentiellement hostile à la science "[dire] que le changement de paradigme ne saurait se justifier par des preuves, ce n'est pas prétendre qu'aucun argument n'a de valeur et qu'on ne peut persuader les scientifiques de changer d'avis" 24. Car il ne voit que trop bien que pousser ce germe relativiste dans ses retranchements reviendrait à nier l'existence de la science comme autre chose qu'un mythe ou une religion. Ce saut là, c'est Feyerabend qui ose le franchir.

"On conclura qu'il est souhaitable de laisser les inclinations aller à l'encontre de la raison dans n'importe quelles circonstances car la science peut en tirer profit [...]. Un conflit entre la raison et les pré-conditions du progrès est possible, il nous indique comment il peut naître et il nous force à conclure que nos chances de progrès peuvent se voir détruites par notre désir d'être rationnel ". 25

"Une nouvelle période dans l'histoire des sciences commence par un retour en arrière qui nous ramène... à un stade antérieur, où la théorie était plus vague et avait un contenu empirique moindre. Ce retour en arrière n'est pas un accident. Il a une fonction définie ; il est essentiel, si nous voulons dépasser le statu quo [...] Retour en arrière vraiment essentiel -- mais comment pouvons nous persuader les autres de nous suivre ? Comment pouvons nous les attirer loin d'un système déjà défini, sophistiqué et fort de son succès empirique, pour les amener à transférer leur intérêt sur une hypothèse incomplète et absurde ? [...] Comment pouvons nous les convaincre que le succès du statu quo n'est qu'apparent, et sera reconnu comme tel dans 500 ans ou plus, alors qu'il n'y a aucun argument de notre coté ? Il est clair que l'attachement aux idées nouvelles devra être provoqué par d'autres moyens que des arguments. Par des moyens irrationnels tel que la propagande, l'émotion, les hypothèses ad hoc, et l'appel à des préjugés de toutes sortes. Nous avons besoin de ces "moyens irrationnels " pour soutenir ce qui n'est qu'une foi aveugle --jusqu'à ce que nous ayons trouvé les sciences auxiliaires, les faits, les arguments qui transforment cette foi en " connaissance" solide." 26

"Pour nous résumer: ou que nous regardions, quels que soit les exemples que nous considérions, nous voyons que les principes du rationalisme critique (prendre les réfutations aux sérieux ; élargir le contenu ; éviter les hypothèses ad hoc ; "être honnête " ---si cela signifie quelque chose--- et ainsi de suite) et a fortiori les principes de l'empirisme logique (être précis ; fonder les théories sur des mesures ; éviter les idées vagues et peu sûres ; et ainsi de suite) rendent mal compte du déroulement passé de la science, et sont susceptibles de retarder les progrès futurs. Ils rendent mal compte d'une science bien plus "molle" et "irrationnelle" que son image méthodologique. Et ils sont susceptible de la retarder car les efforts pour rendre la science plus "rationnelle" et plus précise sont voués à la supprimer, nous l'avons vu [...]. Ces "déviations", ces "erreurs", sont les conditions du progrès. Elles permettent à la connaissance de survivre dans le monde complexe et difficile que nous habitons, elles nous permettent de rester des agents libres et heureux. Sans "chaos", point de savoir. Sans une destitution fréquente de la raison, pas de progrès. Les idées qui aujourd'hui forment la base même de la science n'existe que parce qu'il y a eu des préjugés, de la vanité, de la passion ; parce que cela se sont opposés à la raison ; et parce qu'on les a laissés agir à leur guise. Nous devons conclure que même à l'intérieur de la science, la raison ne peut pas et ne doit pas avoir une portée universelle, qu'elle doit souvent être outrepassée, ou éliminée, en faveur d'autre instances. Il n'y a pas une règle qui reste valide dans toutes les circonstances et pas une seule instance à laquelle on puisse toujours faire appel ". 27

"[L'anarchiste épistémologique] ses buts restent stables, ou changent à la suite d'une discussion, ou par ennui, ou après une expérience de conversion, ou pour impressionner une maitresse -- et ainsi de suite. Si on lui donne un but, il peut essayer de l'atteindre avec l'aide de groupes organisés, ou tout seul, il peut se servir de la raison, de l'émotion, du ridicule, d'un "engagement profond" et de tout autre moyen inventé par les hommes pour obtenir le meilleur de leurs semblables..." 28

Je glisse cependant ici un contre-argument d'Imre Lakatos contre Paul Feyerabend mais retranscris par ce dernier:

"Si aucune argumentation ne peut détruire l'anarchisme épistémologique, on peut cependant démontrer son absurdité: où donc est l'anarchiste qui, par pur esprit de contradiction, sort d'un bâtiment par la fenêtre du 50ème étage au lieu de prendre l'ascenseur ?" 29

Edgar Morin lui aussi n'hésite pas à détruire la ligne de démarcation/le mur entre science et philosophie.

"Il n'y a pas une frontière nette entre science et philosophie. Bien entendu, à leurs pôles, à leur noyau central, elles sont tout à fait différentes puisque le caractère original de la science, c'est surtout l'obsession vérificatrice, falsificationniste, et que l'obsession centrale de la philosophie, c'est la réflexivité et le retour du sujet sur soi même. Mais quand même, il faut dire que dans l'activité scientifique, il y a beaucoup de réflexivité [...] et la philosophie ---par nature--- ne méprise pas en soi la vérification ou l'expérimentation [...]. Certes aujourd'hui, certains néo-technocrates de la science la méprisent [l'activité spéculative et philosophique qui naît de la science] comme séniles spéculations et discussion de fond. Mais ils vieilleront" 30

"Ces même esprits [scientifiques bureaucratisés, formés selon les modes classiques de pensée] ne veulent pas se rendre compte que, contrairement au dogme classique de disjonction entre science et philosophie, les sciences avancées de ce siècle ont toutes rencontré et ré-éclairé les problèmes philosophiques fondamentaux (qu'est ce que le monde ? La nature ? La vie ? L'homme ? La réalité ?) Et que les plus grands scientifiques depuis Einstein, Bohr et Heisenberg, se sont mués en philosophes sauvages." 31

Nietzsche, dans son ouvrage Le gai savoir publié en 1882 c'est-à-dire avec une centaine d'années d'avance sur Feyerabend, entrevoie l'absence de démarcation nette entre science et croyance.

"Préludes à la science: croyez-vous donc que les sciences seraient apparues et se seraient développées si elles n'avaient pas été précédées par les magiciens, alchimistes, astrologues et sorcières, eux qui, par leurs promesses et leurs espérances illusoires, ont dû commencer par créer la soif, la faim et le gout pour les puissances cachées et défendues ?[...] peut-être l'ensemble de la religion apparaitra t'elle, un jour lointain, comme un exercice et un prélude, de la même manière que se présentent à nous, ici, des préludes et des exercices préparatoires à la science qui ne furent absolument pas pratiqués ni ressentis comme tels" 32

Reconstruire la place de l'observateur

A plusieurs reprises, des amis m'ont dit avoir été heurtés/choqués en lisant un ou deux paragraphes de cette thèse, par l'écriture à la première personne c'est-à-dire la présence de nombreux "je". Selon eux, la présence du "je" relève de la prétention et je devrais préférer l'utilisation du "nous" ou de la forme passive. Le problème que j'ai avec le "nous" c'est que je ne suis pas prêt à faire assumer à toute mon équipe les bêtises, fautes et spéculations présentes dans cette thèse. Le problème que j'ai avec la forme passive, c'est que je ne suis pas prêt à laisser entendre/croire que c'est la science/dieu/la vérité qui sort de ma bouche. J'utilise le "je" pour une raison simple: c'est la vérité et je ne vois pas l'intérêt de mettre une couche de maquillage.

Ainsi la science qui est enseignée et pratiquée dans les laboratoires élimine, à tort, l'expérimentateur qui ne devient qu'un observateur indépendant de la nature.

"L'élimination par principe du sujet observateur, expérimentateur et concepteur de l'observation, de l'expérimentation, de la conception, a éliminé l'acteur réel, le scientifique, homme, intellectuel, universitaire, esprit inclus dans une culture, une société, une histoire. On peut même dire que le retour réflexif du sujet scientifique sur lui-même est scientifiquement impossible, parce que la méthode scientifique s'est fondée sur la disjonction du sujet et de l'objet, et que le sujet a été renvoyé à la philosophie et à la morale." 33

Apprendre à s'auto-interroger

Il faut absolument changer cet état de fait:"Le sujet doit se réintroduire de façon autocritique et autoréflexive dans sa connaissance des objets" 34

Edgar Morin fait même une proposition pour la recherche:

"les scientifique [doivent être] aptes à s'auto-interroger ; c'est-à-dire que la science soit apte à s'auto-étudier" 35

L'importance cruciale de la partie immergée de l'iceberg scientifique

"Il y a des croyances non expérimentales et non testables derrière les théories, c'est-à-dire dans l'esprit des savants et des chercheurs ; il y a des impuretés pas seulement métaphysiques mais sans aucun doute sociologique et culturelles"36 "Il y a donc ce problème de l'imagination scientifique qu'on élimine parce qu'on ne saurait l'expliquer scientifiquement mais qui pourtant est à la source des explications scientifiques ".37 "themata [Holton], programme de recherche [Lakatos], paradigme [Kuhn] etc., voici des notions qui introduisent dans la scientificité des éléments apparemment impurs, mais je le répète nécessaire [au] fonctionnement [des sciences]"38

Nietzsche quant à lui s'amuse à chercher les liens qui existent entre le caractère d'un chercheur et la profession de ses parents (notez que nous sommes en 1882 c'est-à-dire une vingtaine d'années avant l'entrée en scène de Freud39 et 80 ans avant l'arrivée de Feyerabend, Morin...):

"Si l'on a un peu exercé son oeil à reconnaître et à prendre sur le fait, à la lecture d'un livre savant, d'un traité scientifique, l'idiosyncrasie [comportement particulier] intellectuelle du savant ---tout savant en possède une---, on apercevra presque toujours derrière elle la "préhistoire" du savant, sa famille, en particulier ses genres de profession et de métier. Là où s'exprime le sentiment "voila qui est prouvé, j'en ai fini avec cela ", c'est ordinairement l'ancêtre dans le sang et l'instinct de savant qui, à partir de sa perspective, approuve le "travail accompli" --la croyance à la preuve n'est qu'un symptôme de ce que l'on a considéré de tout temps, au sein d'une lignée de travailleurs acharnées, comme "du bon travail".[...] Le fils d'un avocat devra être aussi avocat en tant que chercheur: il voudra en premier lieu faire triompher sa cause, en second lieu, peut être avoir raison. Les enfants des maîtres d'école se reconnaissent à l'assurance naïve avec laquelle, en tant que savants, ils considèrent leur cause comme déjà démontrée pour peu qu'ils l'aient exposée avec enthousiasme et chaleur: c'est qu'ils sont fondamentalement habitués à ce qu'on les croie -- chez leurs pères, cela faisait parti du "métier" !" 40

Critique, consensus et intersubjectivité

Selon Morin, "la science se définit non pas par la certitude mais au contraire peut-être par l'incertitude"41. Dés lors, la volonté de chercher une démarcation nette et claire entre science et non science est une idée erronée, une idée de maniaque. C'est la seule erreur de Popper qui, avec son "critère de falsifiabilité" comme principe de démarcation, s'est accolé sans la vouloir une étiquette de positiviste. Pour Morin, la démarcation entre science et non science vient de l'activité qu'entretient la communauté scientifique. Plus précisément, "l'objectivité est le résultat d'un processus critique développé par une communauté/société scientifique jouant un jeu dont elle assume pleinement la règle. [L'objectivité] est produite par un consensus". Comme dit Popper, "l'objectivité des énoncés scientifiques réside dans le fait qu'ils puissent être inter-subjectivement soumis à des tests". Comme le souligne Morin, "il y a un lien inouï entre intersubjectivité et objectivité " 42. On comprend mieux maintenant pourquoi il est si absurde de vouloir éliminer le rôle du sujet observateur.

"L'objectivité scientifique n'exclut pas l'esprit humain, le sujet individuel, la culture, la société: elle les mobilise. Et l'objectivité se fonde sur la mobilisation ininterrompue de l'esprit humain, de ses puissances constructives, de ferments socioculturels et de ferments historiques [...] si l'on veut chercher quelque chose de crucial, c'est la libre communication ; c'est la critique intersubjective qui est le point crucial et nodal de l'idée d'objectivité" 43

Ainsi selon Morin, la critique et le consensus sont responsables, via le fonctionnement de la communauté, de l'émergence de l'objectivité. Ce n'est pas un critère net entre science et non science mais c'est un critère quand même. J'essaierai plus tard de formuler une critique épistémologique contre cette idée que la critique scientifique puisse être à la base de l'émergence de l'objectivité ou de la verité.

La déconstruction du dogme hypothèse-- expérience-- résultat

Dans les paragraphes précédents, nous avons vu que la méthode qui consiste à confronter théorie et expérience est moins pure et donc plus suspecte qu'elle n'y parait. Cela est principalement dû au fait qu'il peut exister des relations de dépendance entre la théorie et l'expérience et parce que les faits peuvent être impurs et véhiculer des idéologies difficilement décelables. Il existe un autre dogme en science. L'idée que la méthode scientifique commence par la formulation d'une question ou d'une hypothèse, suivie par une expérience fournissant des résultats qui seront interprétés afin d'évaluer si l'on obtient une réponse à la question initiale.

Selon le philosophe des sciences Hans-Jörg Rheinberger, la recherche expérimentale en biologie ne commence pas forcément par une théorie, une question clairement formulée. En effet, les systèmes expérimentaux précédent parfois les problèmes qu'ils aident éventuellement à résoudre. Car ces systèmes expérimentaux n'aident pas seulement à répondre aux questions, ils aident à la générer. Ainsi contrairement à ce qu'avance Popper, le développement des disciplines en biologie n'est pas principalement guidé par les idées et les théories: le processus de recherche serait plutôt "guidé de derrière" par les capacités intrinsèques d'un système expérimental que les scientifiques tentent d'explorer. Ainsi un biologiste choisit souvent un organisme modèle qui doit être vu comme un système, une sorte de boite noire. Ce simple choix orientera le type de découvertes qu'il fera et donc au final sa carrière tout entière. La boite noire idéale fournit une dose suffisante de mystère, de difficulté tout en offrant une dose suffisante de reproductibilité pour ne pas décourager l'expérimentateur. La boite noire agit comme un générateur de surprise pour l'expérimentateur qui y explore l'espace des possibles sans forcément qu'une question soit formulée explicitement ou qu'une théorie spécifique soit testée. Parfois, c'est seulement a posteriori, que le biologiste détermine à quelle question répond un résultat donné.

Ainsi pour nous microbiologistes, E. coli est à la fois:

- L’objet d’étude (on cherche à comprendre comment la bactérie fonctionne)

- L’instrument/l’outil (qu’il faut apprendre à « utiliser » et « sentir »)

- Le générateur de question (qui nous oriente vers les découvertes).

Il me semble que beaucoup de scientifiques pensent que :

- il faut formuler une question bien précise avant chaque expérience

- il faut être en mesure de prédire les résultats (positifs ou négatifs) auxquels on s'attend

- il faut si possible contrôler (fixer) tous les paramètres du système pour maximiser la reproductibilité (température, PH etc...)

- il faut privilégier le qualitatif au quantitatif: mieux vaut faire peu d'expériences mais bien (en notant tous les détails parfaitement sur le cahier de manipulation) qu'en faire beaucoup et mal (en négligeant les détails).

Bien que je valide et applique aussi cette méthode, je pense que celle-ci ne suffit pas:

- il faut aussi faire des expériences sans réelle question "juste pour voir/sentir ce qui se passe". Il s'agit d'expériences parfois loufoques, souvent stupides, toujours irréfléchies, basées sur une intuition de dernière minute ou pour tester ce que fait tel produit par exemple. Ce qu'il faut c'est: n'avoir aucune idée du résultat. Pour être honnête, ce type d'expériences (j'en ai fait beaucoup des stupides !) n'a jamais rien donné. Autrement dit, la nature ne m'a jamais accordé une seule fois "serendipity" c'est-à-dire la découverte au hasard qui rend heureux. Pourtant ces expériences sont utiles: elles entretiennent le moral, la curiosité mais surtout elles aident l'expérimentateur à "sentir" sa boite noire, à acquérir une image interne du fonctionnement de la bactérie. Ces sensations, qui ne se laissent pas toujours retranscrire sur papier aisément, aideront à la formulation des questions futures.

- il faut aussi faire des expériences sans contrôler/fixer tous les paramètres. Cela permet petit à petit (au fur et à mesure des problèmes) de connaitre les paramètres qui comptent réellement. En apprenant à isoler puis contrôler uniquement les paramètres qui comptent, on économise l'énergie (en général du temps de manipulation fastidieux) à chercher à contrôler ceux qui ne comptent pas. De plus, on a une meilleure idée de la robustesse de ses résultats aux variations.

Pour synthétiser, je pense qu'il ne faut pas hésiter à faire beaucoup d'expériences "imparfaites" pour "explorer" son système. Cela permet de se heurter à l'incompréhension des résultats, à l'échec avec une fréquence très élevée. Car le plus souvent, la nature ne dévoile ses mystères qu'à ceux qui se sont "plantés" 1000 fois. En effet, les erreurs sont nécessaires. Elles sont le reflet en miroir des erreurs de l'algorithme heuristique de recherche de la connaissance (le schéma de la montagne vu précédemment).

Notes de bas de page

- Edgar Morin, Science avec conscience, p. 17.

- Edgar Morin, Science avec conscience, p. 20.

- Paul Feyerabend, Contre la méthode, Points p. 215.

- Jean-Louis le Moigne, Que sais-je: Les épistémologies constructivistes, PUF p. 20 et 23.

- Jean-Louis le Moigne, Que sais-je: Les épistémologies constructivistes, PUF p. 27 et 32. Dans un objectif de synthèse, j'ai parfois dû remanier le texte de l'auteur ce qui m'a conduit à enlever les guillemets. Cependant mes modifications sont limitées et je considère donc que la paternité de ces phrases revient à l'auteur initial.

- Descartes, Discours de la méthode, le livre de poche, p. 89.

- Paul Valery, cahier I.

- Formule de Th. Dobzhansky (1962).

- Le relativisme, poussé à l'extrême, nie l'existence même de "progrès" (la dérivée positive) qui ne serait qu'une vue de l'esprit. Bien qu'il soit impossible, en l'état actuel des connaissances, de le prouver, je pense qu'il existe un progrès scientifique (je ne suis pas un relativiste). Je propose deux pistes d'étude: la première est dans la théorie des exemplaires, chapitre sur la vie et la seconde est une méthode "scientifique" pour caractériser le progrès à la fin de la partie "analyse du système de publication actuel ".

- Ce paragraphe s'inspire en partie de l'article Wikipedia "La structure des révolutions scientifiques".

- Thomas Kuhn, La structure des révolutions scientifiques, Flammarion p. 64.

- Thomas Kuhn, La structure des révolutions scientifique, Flammarion p. 209.

- Thomas Kuhn, La structure des révolutions scientifique, Flammarion p. 99.

- Jacques Monod, Le hasard et la nécessité, Points p. 198.

- Georges Canguilhem, La connaissance de la vie, bibliothèque des textes scientifiques p. 56 (extrait d'une conférence).

- Paul Feyerabend, Contre la méthode, Points p. 68.

- Paul Feyerabend, Contre la méthode, Points p. 81.

- Paul Feyerabend, Contre la méthode, Points p. 67.

- Paul Feyerabend, Contre la méthode, Points p. 187.

- Harry Collins, Tout ce que vous devriez savoir sur la science, Points p. 69.

- Thomas Kuhn, La structure des révolutions scientifiques, Flammarion p. 204.

- Thomas Kuhn, La structure des révolutions scientifiques, Flammarion p. 207.

- Thomas Kuhn, La structure des révolutions scientifiques, Flammarion p. 136.

- Thomas Kuhn, La structure des révolutions scientifiques, Flammarion p. 207.

- Paul Feyerabend, Contre la méthode, Points p. 170.

- Paul Feyerabend, Contre la méthode, Points p. 165--166.

- Paul Feyerabend, Contre la méthode, Points p. 195--196.

- Paul Feyerabend, Contre la méthode, Points p. p209.

- Paul Feyerabend, Contre la méthode, Points p. 244.

- Edgar Morin, Science avec conscience, Points p. 57.

- Edgar Morin, Science avec conscience, Points p. 9.

- Nietzsche, Le gai savoir, Flammarion p. 245.

- Edgar Morin, Science avec conscience, Points p. 20.

- Edgar Morin, Science avec conscience, Points p. 29.

- Edgar Morin, Science avec conscience, Points p. 31.

- Edgar Morin, Science avec conscience, Points p. 43.

- Edgar Morin, Science avec conscience, Points p. 46.

- Edgar Morin, Science avec conscience, Points p. 45.

- Prélude à la découverte de l'inconscient?

- Nietzsche, Le gai savoir, Flammarion p. 294--295.

- Edgar Morin cite Whitehead.

- Morin, Science avec conscience, Points p. 41.

- Edgar Morin, Science avec conscience, Points p. 56.