Un peu d'histoire de la biologie

Préambule

Paradoxalement, ce premier chapitre n'est pas le plus facile. Il est relativement abstrait et théorique. Si vous êtes novice en biologie, je vous conseille plutôt de commencer avec le deuxième chapitre sur E. coli. Dans la première partie de ce chapitre d'histoire, je décris les principales découvertes du 20ème siècle (de manière non exhaustive) qui ont abouti à la création du paradigme (manière de voir le monde) actuel en biologie. La deuxième partie se focalise sur les ouvrages de François Jacob et Jacques Monod pour essayer d'extraire les caractéristiques essentielles de ce paradigme. Il me semble que le lecteur qui s'engage dans ce chapitre devrait, idéalement, déjà connaître au moins 50% de ce qui y est expliqué pour que la lecture ne soit pas trop difficile. Si l'histoire des sciences ou la biologie théorique n'est pas votre tasse de thé, passez aux chapitres suivants sans crainte: ils sont plus concrets.

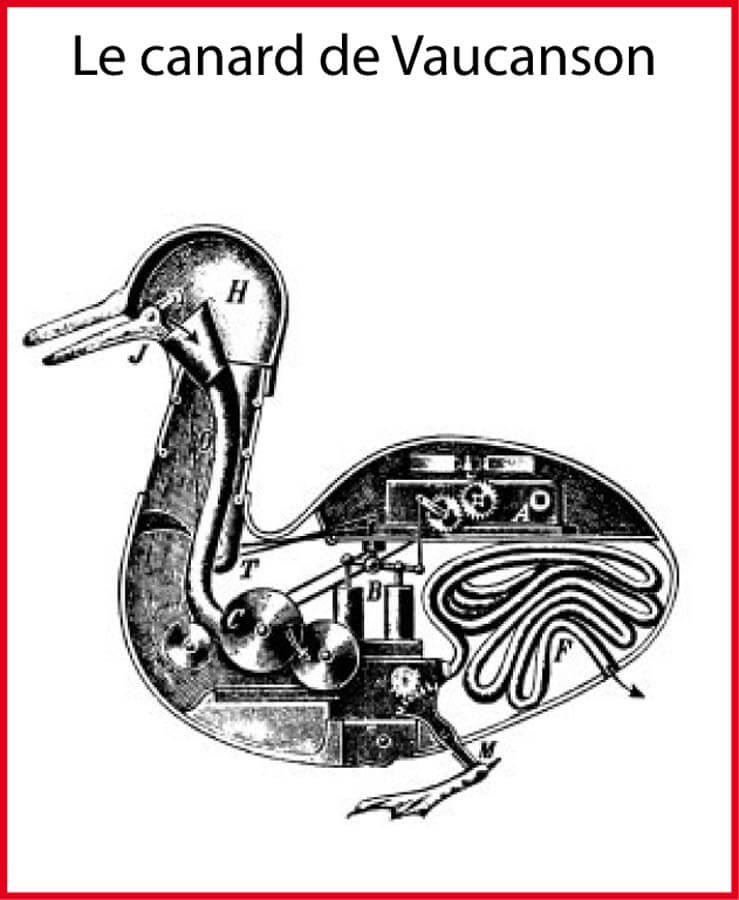

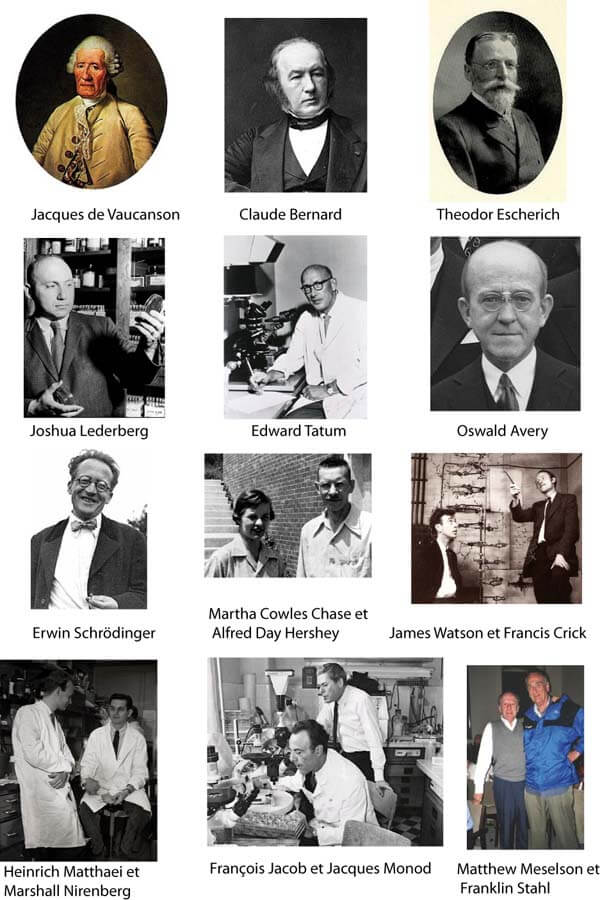

La fin du vitalisme

Le canard automate du grenoblois Jacques de Vaucanson (1709--1782) accomplit une fonction: la digestion. Les engrenages qui le composent nous indiquent que pour comprendre un système, il faut le contrôler. Si on contrôle la fonction (la digestion) en faisant tourner l'engrenage, alors on comprend comment le mécanisme fonctionne. Dans mon exposé, la bactérie Escherichia coli ne représente qu'un moyen pour comprendre et pour contrôler la vie. Ces deux verbes étant, selon moi, difficilement dissociables. L'introduction historique que je me propose de faire n'est donc pas celle des découvertes relatives au fonctionnement de la bactérie Escherichia coli. Je souhaite plutôt retracer brièvement l'évolution, au cours des deux derniers siècles, des idées et concepts associés, de prés ou de loin, à la notion de vie ---concepts qui ont émergé en grande partie grâce à l'étude de cette bactérie---. Nous allons voir comment les caractéristiques du vivant se sont, au fur et à mesure, précisées au cours des deux derniers siècles. Mais ne nous leurrons pas, le consensus actuel dans la communauté scientifique est qu'il n'existe pas justement de consensus sur la définition de la vie. Et comme le fait remarquer le fondateur de l'exobiologie Carl Sagan (1934--1996), cela est assez remarquable.

" Yet despite the enormous fund of information that each of these biological specialties has provided, it is a remarkable fact that no general agreement exists on what it is that is being studied. There is no generally accepted definition of life " 1

Le vitalisme est une doctrine selon laquelle il existe en chaque être vivant un principe vital distinct des propriétés physico-chimiques de celui-ci. Le déclin de cette doctrine commence en 1828 lorsque Friedrich Wöhler (1800--1882) effectue accidentellement la synthèse de l'urée, un composé spécifiquement organique. La synthèse des molécules organiques en chimie montre qu'entre la nature et le vivant, il n'y a pas de différence de nature mais de complexité. Au début du 19ème, l'organisme dépensait de la force vitale pour effectuer son travail de synthèse et de morphogenèse, à la fin du 19ème siècle, il consomme de l'énergie. La vie semble alors caractérisée par l'existence de catalyseurs spécifiques (les enzymes), capables de réaliser des réactions que le chimiste ne sait faire que dans des conditions extrêmes.

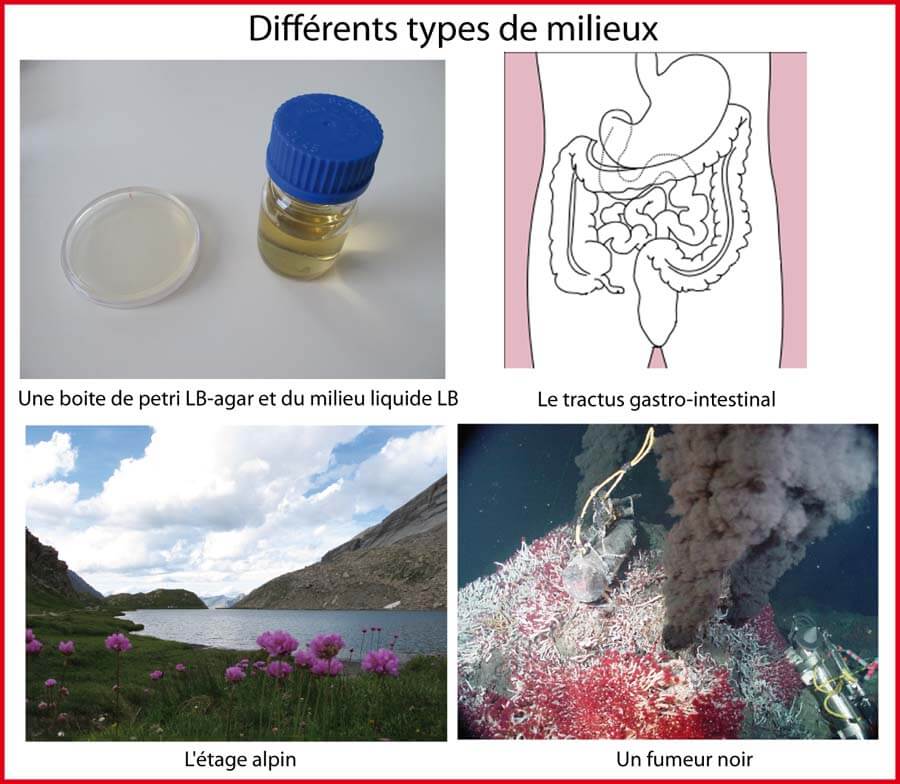

L'organisme est indissociable de son milieu

Une autre notion importante apparait à cette période: le milieu. Nous devons à Auguste Comte (1798--1857) une définition précise de cette notion de milieu: "non plus seulement le fluide dans lequel un corps est plongé mais l'ensemble total des circonstances extérieures nécessaire à l'existence de chaque organisme"2. Mais c'est Claude Bernard (1813--1878) qui a l'idée que "le phénomène vital n'est tout entier ni dans l'organisme ni dans le milieu: c'est en quelque sorte un effet produit par le contact entre l'organisme vivant et le milieu qui l'entoure" . Comme le souligne François Jacob, c'est aussi au cours de cette période que la biologie change de lieu de travail: auparavant dans la nature, dans les musées ou dans les jardins botaniques, désormais la biologie se fait en laboratoire. Les scientifiques comprennent que, pour étudier un être vivant, il faut le placer dans des conditions de milieu aussi définies que possibles puis faire varier systématiquement chacun des paramètres du milieu.

" Il n'est pas exagéré de dire que depuis lors, cette manière de procéder constitue la principale activité des laboratoires de biologie " 3.

Du simple sac d'enzymes à la découverte des gènes

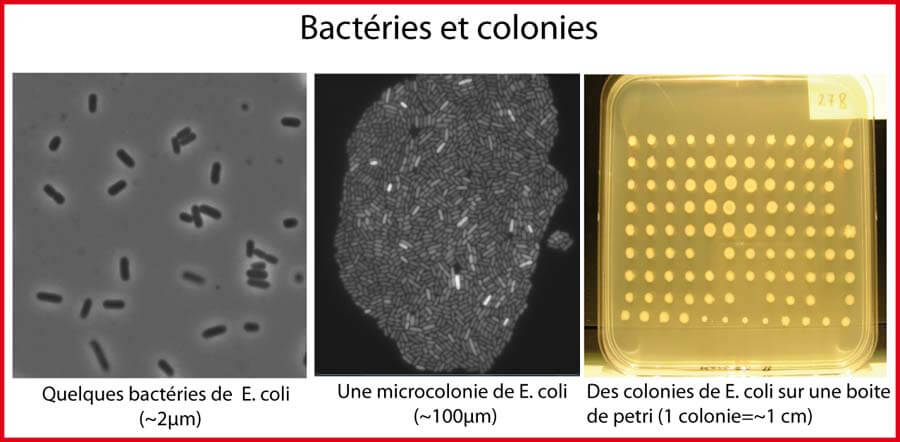

En 1885, un pédiatre allemand, Théodore Escherich, isole des bactéries provenant de couches de bébé. Il remarque une bactérie capable de croissance massive et rapide sur de très nombreuses sources de nourriture: lait, pomme de terre, sang. A cette époque, les micro-organismes sont vus comme de simples fours, à la frontière entre vie et non-vie, capables de brûler la nourriture pour créer de la chaleur, des déchets et des molécules organiques. Les bactéries restent donc un mystère car elles sont beaucoup plus petites que les autres organismes connus à cette époque et elles ne possèdent pas de noyau. Théodore Escherich ne se doutait probablement pas que quelques dizaines d'années plus tard, les scientifiques du monde entier commenceraient à cultiver "sa bactérie" en faisant des centaines de milliers d'expériences pour comprendre comment elle survit, se reproduit ou se nourrit. En 1919, en hommage à son découvreur, on nomme cette bactérie Escherichia coli 5.

Pendant encore longtemps, de nombreux chercheurs considèrent les bactéries comme de simples sacs à enzymes. Jusqu'à ce que, dans les années 1940, Edward Tatum et George Beadle mènent leur célèbre expérience d'irradiation, d'abord chez Neurospora crassa (Beadle and Tatum 1941) puis chez la bactérie E. coli. Pour sa croissance, E. coli a seulement besoin d'un milieu contenant une source de carbone, d'azote, de phosphate ainsi que de l'eau et des éléments traces. A partir de ce milieu, elle est capable, grâce à ses enzymes, de bio-synthétiser chacun des 22 acides aminés. En irradiant des millions de bactéries, Edward Tatum découvrit, parmi les bactéries survivantes, certains mutants capables de croitre seulement lorsqu'il ajoutait un acide aminé particulier dans le milieu: Cela signifiait qu'une des enzymes nécessaires à la biosynthèse de l'acide aminé ajouté avait été inactivée, d'une manière ou d'une autre, par l'irradiation. Plus surprenant encore, les bactéries mutantes pouvaient se reproduire, mais les générations suivantes conservaient le défaut. Celui-ci était donc transmis. Le chercheur en conclut que derrière chaque enzyme se cachait un gène.

Joshua Lederberg, jeune étudiant d'à peine 21 ans, commença à travailler dans le laboratoire d'Edward Tatum avec une grande ambition: mettre en évidence un échange de matériel génétique entre bactéries, autrement dit du sexe bactérien. Pour cela il utilisa deux doubles mutants. L'un incapable de synthétiser ni la méthionine ni la biotine et l'autre incapable de synthétiser ni la thréonine ni la proline. Le jeune chercheur mélangeât ensuite ces deux souches en culture en ajoutant les 4 nutriments dans le milieu pour leur permettre de croître. Il les laissa ensemble plusieurs semaines pour leur laisser de nombreuses opportunités d'avoir de l'hypothétique "sexe" . Puis il retira les 4 nutriments et regarda si parmi les descendants, certains avaient acquis la possibilité de pousser. Après des mois de frustration, de boites de pétri gâchées et de colonies mortes, il repéra finalement une colonie capable de pousser sur les 4 nutriments. Rappelons ici qu'une colonie est une population visible qui apparait, sur un milieu solide, après croissance exponentielle d'une bactérie unique. Il en conclut que les ancêtres (les deux doubles mutants) avaient du combiner leurs gènes ensemble (Tatum and Lederberg 1947). En permettant de croiser des souches d'E. coli comme on croise des drosophiles, cette découverte permit d'avoir une compréhension beaucoup plus précise de ce qu'est un gène et offrit un outil pour disséquer le chromosome. 12 ans plus tard, Joshua Lederberg partagea le prix Nobel de médecine avec Edward Tatum et George Beadle.

L'influence de la thermodynamique et des physiciens

Au cours de mes lectures, j'ai pu constater qu'il y a un principe qui est cité plus que tout autre par les biologistes théoriciens. Il s'agit du deuxième principe de la thermodynamique. Ce principe définit la tendance de tout système physique à évoluer naturellement vers un état d'équilibre caractérisé par une certaine uniformité. L'augmentation de l'entropie signifie simplement que des objets vont explorer spontanément tout l'environnement dont ils disposent. Une métaphore simple pour le comprendre est celle de la goutte d'encre bleue ajoutée à un verre rempli d'eau. Très concentré au début, les molécules d'encre vont explorer tout le verre jusqu'à ce que la concentration (la couleur bleue) devienne homogène. Ce processus est irréversible. Erwin Schrödinger (1887--1961) est un physicien autrichien qui a eu une influence considérable sur le développement de la biologie moléculaire. Dans son petit ouvrage Qu'est ce que la vie écrit en 1944, il décrit sa conception de la matière vivante qui "évite la décomposition vers l'équilibre" et se "nourrit d'entropie négative" . Ainsi, selon cette vision, les être vivants sont "des systèmes ouverts en déséquilibre thermodynamique" qui échangent en permanence matière et énergie avec le milieu qui les entoure. Cela n'est pas en contradiction avec le second principe car l'ensemble de l'univers (les êtres vivants et leur milieu) tend bien, lui, vers une augmentation d'entropie 6. Ainsi, à travers le prisme de la physique statistique, la cellule est un sac où des quantités énormes d'atomes et de molécules diffusent dans le liquide cellulaire. Comment la physique statistique peut-elle expliquer les mécanismes de l'hérédité ? Elle ne le peut pas et Erwin Schrödinger comprend que c'est une macromolécule unique, un cristal apériodique qui est responsable de la transmission à la descendance et non une goutte homogène de liquide. Il va même plus loin en proposant la première métaphore directement liée à l'informatique: Erwin Schrödinger propose que le gène est un message écrit en code.

" En biologie, nous nous trouvons en face d'une situation entièrement différente. Un seul groupe d'atomes n'existant qu'en un seul exemplaire produit des événements ordonnés et merveilleusement harmonisés l'un avec l'autre ainsi qu'avec le milieu environnant, et cela grâce à des lois extraordinairement subtiles . [...]Nous croyons qu'un gène ---ou peut être l'ensemble de la fibre chromosomique--- est un solide apériodique. [Puis dans les notes de bas de page] Le fait d'être éminemment flexible n'est pas une objection car un mince fil de cuivre l'est également. [...] Une molécule exceptionnellement grosse, qui doit être nécessairement un chef-d'oeuvre d'un ordre très complexe, placé sous la baguette magique de la théorie des quanta. [...] Ce que nous voulons faire ressortir est simplement ceci: avec l'image moléculaire du gène il n'est plus inconcevable que le code en miniature puisse se trouver en correspondance exacte avec un plan de développement très complexe et très élaboré et contenir en même temps les moyens de le mettre à exécution " 7.

L'ADN support de l'information génétique

Jusqu'aux années 1950, la plupart des scientifiques pensaient que les protéines étaient le support des gènes et donc de l'information génétique. En 1928, Frederick Griffith travaillait sur la bactérie Streptococcus pneumoniae. Il disposait d'une souche virulente et d'une souche non virulente. L'une capable de tuer une souris l'autre pas. Lorsqu'il tuait la souche virulente en la chauffant avant de l'injecter à une souris, cette dernière survivait. Cependant, si la souche virulente morte était mélangée à la souche non virulente vivante, une injection tuait la souris. La souche non virulente s'était transformée en souche pathogène et leurs descendants restaient pathogènes et ce grâce à un composé provenant de la souche morte. Il fallut attendre 1944 pour que Oswald Avery purifie la substance transformante et découvre que la seule molécule capable de "transformer" la souche non virulente en souche pathogène n'était pas une protéine mais une chose appelée acide désoxyribonucléique: l'ADN (Avery et al. 1944).

" If, however the biologically active substance isolated in highly purified form as the sodium salt of desoxyribonucleic acid actually proves to be the transforming principle, as the available evidence strongly suggest, then nucleic acids of this type must be regarded not merely as structurally important but as functionally active in determining the biochemical activities and specific characteristics of pneumococcal cells. "

Mais il fallut encore 10 ans de plus et l'expérience de Alfred Hershey et Martha Chase pour que ce résultat soit pleinement accepté par la communauté scientifique. Ces deux chercheurs mirent au point une expérience en utilisant des bactériophages. C'est-à-dire un virus de bactérie composé uniquement d'une coque protéique et de matériel génétique. Un phage infecte une bactérie en s'attachant à sa membrane externe et en y injectant son matériel génétique qui détournera la machinerie cellulaire bactérienne pour créer de nouveaux virus. Dans leur première expérience, les deux chercheurs marquèrent l'ADN des phages avec du 32P radioactif (le phosphate est présent dans l'ADN mais absent des 22 acides aminés). Puis ils permirent aux phages d'infecter E. coli. Après avoir séparé les phages des bactéries par centrifugation, ils montrèrent que le marqueur radioactif n'était visible que dans le culot bactérien, pas dans le surnageant qui contenait les coques protéiques. Dans leur seconde expérience, les deux chercheurs marquèrent les protéines des phages avec du 35S radioactif (le souffre est présent dans 2 acides aminés mais est absent de l'ADN). Après séparation, le marqueur radioactif fût trouvé dans les coques protéiques mais pas dans les bactéries infectées. Ce résultat prouva que c'est bien l'ADN et non les protéines qui passe du phage à la bactérie. Ainsi 10 ans après Oswald Avery, l'expérience de Hershey et Chase prouva définitivement que l'ADN était bien le support de l'information génétique (Hershey and Chase 1952).

" We have shown that when a particle of bacteriophage T2 attaches to a bacterial cell, most of the phage DNA enters the cell, and a residue containing at least 80 per cent of the sulfur-containing protein of the phage remains at the cell surface [...] this residue plays no further role in infection after the attachment of phage to bacterium."

La réplication de l'information génétique

Personne n'était plus excité par ces résultats qu'un jeune biologiste américain nommé James Watson. Mais pour comprendre comme l'ADN agissait comme matériel génétique, il était nécessaire de comprendre sa structure. A cette époque, Watson travaillait à l'université de Cambridge où il commença à réfléchir avec Francis Crick un physicien anglais. En se basant sur les analyses cristallographiques aux rayons X de Rosalind Franklin, ils proposèrent la structure en double hélice de la molécule d'ADN. Les deux clés de ce problème étaient: d'une part, la structure hélicoïdale; d'autre part, l'observation que la structure chimique de l'ADN est composée de quatre bases (A, T, G, et C), et que les deux paires de bases A-T et G-C ont des structures complémentaires sur le plan stérique. La structure qu'ils proposaient semblait expliquer d'elle-même comment fonctionnent les gènes. Chaque brin d'ADN est un empilement de millions de bases arrangées en ligne comme une chaine de caractère. Le texte peut avoir un nombre infini de signification, dépendant de l'empilement des bases. De cette manière, l'ADN stocke l'information nécessaire pour construire n'importe quelle protéine de n'importe quelle espèce (Watson and Crick 1953). Selon la légende, alors que les deux chercheurs marchaient en direction du pub "Eagle" pour déguster une petite bière bien fraiche, Francis Crick se serait exclamé "nous avons trouvé le secret de la vie" . Cela révèle le fort désir, la forte pression qui régnait à l'époque pour percer enfin les mécanismes de transmission du patrimoine génétique. Mais notez bien que le secret de la vie et sa définition sont ailleurs. Et cet ailleurs pourrait être encore très loin.

" We wish to suggest a structure for the salt of desoxyribose nucleic acid (DNA). This structure has novel features which are of considerable biological interest [...] It has not escaped our notice that the specific pairing we have postulated immediately suggests a possible copying mechanism for the genetic material "

Cette structure de l'ADN en double hélice suggérait aussi comment l'ADN se duplique. Les deux chercheurs visualisèrent comment les deux brins complémentaires se séparaient pour permettre la synthèse de deux nouveaux brins. Cette idée de réplication semi-conservative était séduisante mais il manquait aux deux chercheurs la preuve nécessaire. Et il fallut attendre Matthew Meselson et Franklin Stahl qui mirent en oeuvre ce qui allait être considéré comme l'une des plus belles expériences de la biologie.

Les deux chercheurs réalisèrent qu'ils pouvaient suivre la réplication de l'ADN en laissant pousser les bactéries E. coli pendant plusieurs générations dans un milieu composé d'azote lourd à 15 nucleons. Après avoir extrait l'ADN, ils le centrifugèrent sur un gradient de densité salin de manière à ce que l'ADN arrête sa migration lorsque sa densité devient égale à celle de la solution saline. L'ADN des bactéries ayant poussées dans un milieu avec de l'azote 15N avait une densité plus haute que l'ADN des bactéries ayant poussées dans un milieu avec de l'azote normal 14N. Les deux chercheurs firent alors une seconde expérience. Ils placèrent les bactéries qui avaient poussé sur de l'azote 15N dans un milieu avec de l'azote normal 14N. La croissance bactérienne était alors surveillée pour ne permettre aux bactéries qu'une seule division. Si Watson et Crick avaient raison alors Meselson et Stahl savaient à quoi s'attendre: les 2 brins lourds devaient s'être séparés et un nouveau brin léger devait s'être ajouté à chacun des brins lourds. Après centrifugation sur le gradient de densité salin, l'ADN devrait former une bande à mi-distance entre la bande correspondant à l'ADN fait d'azote lourd (15N) et celle fait d'azote léger (14N). Et c'est exactement ce qu'ils virent (Meselson and Stahl 1958).

"By means of density gradient centrifugation, we have observed the distribution of 15N among molecules of bacterial DNA following the transfer of a uniformly 15N-substituted exponentially growing E. coli population to 14N medium. We find that the nitrogen of a DNA molecule is divided equally between two physically continuous subunits; that, following duplication, each daughter molecules receives one of these; and that the subunits are conserved through many duplication."

Un code génétique universel

Dés 1956, Francis Crick proposait ce qui allait devenir le dogme central de la biologie moléculaire. L'ADN est transcrit en ARN qui est traduit en protéine. Cependant, à cette époque, on ne savait pas encore quel dictionnaire utilisait E. coli pour traduire les instructions écrites dans le langage des gènes en langage des protéines. En 1961, Francis Crick, aidé par les suggestions d'un physicien théoricien nommé George Gamow, démontra qu'une succession de 3 bases d'ADN (appelé codon) codait pour une acide aminé. Commença alors une course pour "cracker " le code génétique. Marshall Nirenberg and Johann Matthaei découvrirent la première entrée du dictionnaire ADN--Protéine (Nirenberg et al. 1965). Ils broyèrent une culture d'E. coli et déposèrent le broyat dans une série de 20 tubes test. Ils ajoutèrent dans chacun des 20 tubes un acide aminé radioactif différent ainsi qu'un ARN synthétique poly-U (un ARN composé uniquement de bases uracile). Dans 19 tubes, rien ne se produisit. Mais, dans le 20ème tube, le samedi 27 mai 1961, à 3 heures du matin, les mesures de radioactivité indiquèrent la présence d'un long polypeptide composé entièrement de l'acide aminé phénylalanine. Nirenberg and Matthaei conclurent que la séquence d'ARN "UUU " codait l'addition d'une phénylalanine à n'importe quelle chaine de protéine en formation.

" The result indicates that polyuridylic acid contains the information for the synthesis of a protein having many of the characteristics of poly-L-phenylalanine."

Dans les années qui suivirent, le code génétique fut entièrement décrypté (Nirenberg et al. 1965). En 1967, Nirenberg et ses collègues annoncèrent qu'ils avaient trouvé "un code génétique essentiellement universel". Cela signifie que tous les êtres vivants sont composés d'ADN, d'ARN et de protéines et que le code qui permet la transcription puis la traduction de l'ADN en protéine est le même pour tous les être vivants. Ainsi selon la fameuse expression de Jacques Monod "ce qui est vrai pour E. coli est vrai pour un éléphant ". Ce qui différencie principalement deux organismes vivants, c'est la taille du génome et la suite des symboles (A,T,C,G) qui le constitue.

"C'est aux biologistes de ma génération qu'a été accordée cette révélation de la quasi-identité de la chimie cellulaire dans la biosphère entière."

La séquence semble aléatoire

Autre point important à noter c'est la révélation (et la déception) que la séquence d'une protéine (ou du gène correspondant) ne révèle aucune régularité ni aucune singularité qui pourrait aider à déterminer sa structure tridimensionnelle ou ses propriétés. Comme le remarque Jacques Monod, la loi générale qui semble décrire ces séquences, c'est celle du hasard.

" Ces structures sont "au hasard " en ce sens que, connaissant exactement l'ordre des 199 résidus dans une protéine qui en comprend 200, il est impossible de formuler aucune règle théorique ou empirique, qui permettrait de prévoir la nature du seul résidu non encore identifié par l'analyse. [...] Messages qui, par tous les critères possibles, semble avoir été écrit au hasard. Message cependant chargé d'un sens qui se révèle dans les interactions discriminatives, fonctionnelles, directement téléonomiques, de la structure globulaire, traduction à trois dimensions de la séquence linéaire. " 8

La simplicité extrême du code génétique contraste avec la complexité extrême de la séquence d'un génome qui semble principalement guidée par le hasard. Je m'explique. Le code génétique est un code. Exactement comme un humain coderait un texte dont il veut éviter la lecture aux curieux. Casser ce code a été d'une simplicité enfantine (pardon pour les expérimentateurs dont je ne récolterais sans doute pas l'adhésion sur ce point et à juste titre). Ce code est très proche d'une construction cognitive triviale faite par l'homme et c'est cela qui m'est incompréhensible. A l'opposé de cette simplicité, remarquez la complexité de la séquence d'un génome. Cette dernière semble presque indistinguable d'une séquence aléatoire. Elle a subi des cycles et des cycles d'optimisation grâce à l'algorithme génétique qui tourne depuis plusieurs milliards d'années d'histoire évolutive. Le code sous jacent est capable d'engendrer un déterminisme inouï (l'organisme). Sa complexité, à l'opposé du code génétique, est pour l'instant totalement hors de portée et cela me semble déjà beaucoup plus naturel. Pourquoi certains mécanismes choisis par la nature nous semblent si transparents et d'autres si opaques ?

La découverte du code génétique marque définitivement l'entrée d'une nouvelle discipline, la biologie moléculaire. Son dogme central décrit le sens de transfert de l'information génétique. L'ADN est transcrit en ARN qui est traduit en protéine. Ce transfert est à sens unique. Voici ci-dessous quelques citations de François Jacob.

" [La biologie moléculaire] s'installe délibérément à l'une des frontières du monde vivant, à la limite de l'inanimé. Le niveau inférieur se décrit en termes de chimie et de physique. Le niveau supérieur en termes d'organisation, de système logique [...] Mais la nature du système et les méthodes d'observation permettent toujours de considérer ensemble les deux niveaux, de comparer sans cesse le tout de l'organisme et le détail des constituants ou des phénomènes que met en évidence l'analyse [...] C'est dans la comparaison des deux niveaux qu'émerge la description de la cellule bactérienne. [...] L'analyse génétique ne vise plus uniquement alors simplement à démonter le mécanisme de l'hérédité. Elle devient un outil de précision servant à repérer les constituants de la cellule, leur rôle, leur interaction avec les autres éléments. Ce qu'on cherche avec les mutations, c'est à disséquer la cellule sans la détruire." 9

Un programme coordonné

Dans les années 60, le génome était considéré comme une série de plans de protéines: les gènes. L'intérêt de ces plans semblait résider principalement dans la capacité à être transmis à la descendance. Grâce à Jacob et Monod, le génome ne fut plus qu'un simple plan mais un programme codant pour un réseau complexe dans lequel les gènes régulent leurs activités pour permettre l'adaptation de la bactérie à son environnement (Jacob and Monod 1961).

" According to the strictly structural concept, the genome is considered as a mosaic of independent molecular blue-prints for the building of individual cellular constituents. In the execution of these plans, however, co-ordination is evidently of absolute survival value. The discovery of regulator and operator genes, and of repressive regulation of the activity of structural genes, reveals that the genome contains not only a series of blue-prints, but a co-ordinated program of protein synthesis and the means of controlling its execution "

En relisant Jacob et Monod, on se rend compte à quel point la description (le dogme) du fonctionnement de la cellule a relativement peu évolué en l'espace de quelques décennies. Ce qu'ils expliquent en 1960--1970 dans leurs ouvrages respectifs correspond 40 ans plus tard au paradigme (manière de voir le monde) de départ sur lequel se basent mes travaux de thèse.

" En confrontant systématiquement la logique et l'expérience, selon la méthode scientifique, c'est en fait toute l'expérience de [nos] ancêtres que nous confrontons avec l'expérience actuelle. " 10

Puisque que comme nous l'explique Jacques Monod, nous (scientifiques actuels) confrontons nos expériences avec celles de nos ancêtres, il me faut admettre qu'effectivement aucune de mes expériences n'a été en mesure d'ébranler ne serait-ce que d'un nanomètre ce paradigme. Certes vous me rétorquerez que cela n'est pas un gage de solidité... Mais j'insiste ici sur l'idée que le "but " de tout chercheur qui travaillerait sur un sujet similaire au mien ---et c'est un sujet qui sera proposé encore longtemps--- a pour mission de tenter, par tous les moyens, de briser ou de dépasser ce paradigme. Son échec renforce le paradigme. Plutôt que de paraphraser nos deux prix Nobel, je vous propose de faire une petite étude de leurs textes et du paradigme qui s'y cache.

Analyse de texte du paradigme actuel

Voici des citations de l'ouvrage de Jacques Monod, le hasard et la nécessité. Ce petit ouvrage, très facile d'accès, enchantera par la clarté de son propos. Les considérations politiques, que l'auteur aborde à la fin de son ouvrage, seront discutées plus tard.

La pierre angulaire de la méthode scientifique est le postulat de l'objectivité de la Nature. C'est-à-dire le {refus systématique} de considérer comme pouvant conduire à une connaissance "vraie" toute interprétation des phénomènes donnés en termes de causes finales, c'est-à-dire de "projet" . [...] Postulat pur, à jamais indémontrable, car il est évidemment impossible d'imaginer une expérience qui pourrait prouver la non-existence d'un projet, d'un but poursuivi, où que ce soit dans la nature [...] L'objectivité cependant nous oblige à reconnaître le caractère téléonomique des êtres vivants, à admettre que dans leurs structures et performances, ils réalisent et poursuivent un projet. Il y a donc là, au moins en apparence, une contradiction épistémologique profonde. Le problème central de la biologie, c'est cette contradiction elle-même, qu'il s'agit de résoudre si elle n'est qu'apparente, ou de prouver radicalement insoluble si en vérité il en est bien ainsi.

Nous admettrons cependant l'hypothèse que, dans ce système, les interactions moléculaires qui assurent la transmission et l'interprétation des signaux chimiques sont dues à des protéines douées de propriétés de reconnaissance stéréospécifiques différentielles, auxquelles s'applique le principe essentiel de gratuité chimique tel qu'il se dégage de l'étude des interactions allostériques proprement dites.

On peut donc voir une contradiction dans le fait de dire que le génome "définit entièrement" la fonction d'une protéine, alors que cette fonction est attachée à une structure tridimensionnelle dont le contenu informatif est plus riche que la contribution directement apportée à cette structure par la détermination génétique [...] l'enrichissement d'information correspondant à la formation de la structure tridimensionnelle provient de ce que l'information génétique (la séquence) s'exprime en fait dans des conditions initiales bien définies (en phase aqueuse, entre certaines limites étroites, de températures, composition ionique, etc. ) telles que parmi toutes les structures possibles, une seule d'entre elles est en fait réalisable.

Il s'ensuit en effet qu'il n'y a pas de mécanisme possible par quoi la structure et les performances d'une protéine pourraient être modifiées et ces modifications transmises, fût-ce partiellement, à la descendance, si ce n'est comme conséquence d'une altération des instructions représentées par un segment de séquence de l'ADN. Tandis qu'inversement, il n'existe aucun mécanisme concevable par quoi une instruction ou information quelconque pourrait être transférée à l'ADN. Le système tout entier, par conséquent, est totalement, intensément conservateur, fermé sur soi-même, et absolument incapable de recevoir quelque enseignement que ce soit du monde extérieur.

Nous disons que ces altérations sont accidentelles, qu'elles ont lieu au hasard. Et puisqu'elles constituent la seule source possible de modifications du texte génétique, seul dépositaire à son tour des structures héréditaires de l'organisme, il s'ensuit nécessairement que le hasard seul est à la source de toute nouveauté, de toute création dans la biosphère. Le hasard pur, le seul hasard, liberté absolue mais aveugle, à la racine même du prodigieux édifice de l'évolution.

En ce sens l'évolution sélective, fondée sur le choix des rares et précieux incidents que contient aussi, parmi une infinité d'autres, l'immense réservoir du hasard microscopique, constitue une sorte de machine à remonter dans le temps.

Passons maintenant à l'ouvrage de François Jacob la logique du vivant, livre plus long et donc un petit peu plus difficile d'accès mais qui représente une formidable histoire de la biologie. Inutile de préciser qu'il a eu une très forte influence sur ce chapitre.

Ce qui est chiffré le long de la chaîne nucléique, ce qui est recopié signe par signe pour être scrupuleusement transmis d'une génération à l'autre, c'est la collection des plans détaillant les architectures de la cellule bactérienne ; c'est l'ensemble des prescriptions permettant d'échafauder minutieusement toute la série des édifices protéiques. Le programme n'est pas transcrit et traduit d'un trait mais par segments. La lecture du message peut être comparée, non à celle d'un rouleau qu'on déviderait d'un bout à l'autre, mais plutôt à celle d'un livre d'instructions dont on consulte les pages en fonction des besoins. Certaines régions du programme contiennent des directives qui renvoient à d'autres régions selon les circonstances.

La lecture du message génétique ressemble ainsi à la musique que produisent les machines à disques dans les cafés. En appuyant sur un des boutons, on peut choisir parmi les disques de la machine, celui qu'on désire entendre. Mais en aucun cas on ne peut modifier ni le texte ni l'exécution de la musique enregistrée. De même, un segment du texte génétique contenu dans le chromosome de la cellule bactérienne peut être transcrit ou non, selon les signaux chimiques reçus du milieu ; mais ceux-ci n'en peuvent modifier la séquence, donc la fonction. Le vieux mot d'adaptation couvre ainsi deux choses différentes. D'un coté il s'agit d'un phénomène survenant chez l'individu ; il traduit en quelque sorte la réponse de l'organisme à quelques facteurs externes, mais c'est toujours dans les limites permises par les instructions contenues dans le programme. De l'autre coté, au contraire, il s'agit de modifications survenant dans une population, c'est alors un changement du programme lui-même, sous l'effet d'une pression qui favorise certains des programmes à mesure qu'ils apparaissent.

La plupart des situations auxquelles peut se trouver confronté un colibacille sont prévues dans le message. Le programme contient ainsi les plans de toutes les pièces nécessaires pour faire une bactérie et il donne à celle-ci les moyens de faire face aux difficultés de la vie courante. Mais ce n'est qu'un programme. Dans les processus qui conduisent à recopier la séquence nucléique, soit par la reproduction soit pour les synthèses protéiques, l'ADN joue le rôle passif d'une matrice. Hors de la cellule, sans les moyens d'exécuter les plans, sans l'appareillage de copie ou de traduction, il reste inerte, tout comme reste inerte une bande magnétique hors de son magnétophone. Pas plus que la mémoire d'une calculatrice, celle de l'hérédité n'agit par elle-même. Fonctionnel seulement au sein de la cellule, le message génétique ne fait rien tout seul. Il peut seulement guider ce qui fait. Pour que soient produites les machines à partir des plans, il faut les machines. Aucune des substances qu'on peut extraire de la cellule n'a la propriété de se reproduire. Seule la bactérie, la cellule intacte, est capable de croitre et se reproduire car elle seule possède à la fois le programme et le mode d'emploi, les plans et les moyens de les exécuter.

Ces moyens d'exécution, ce sont les protéines. Sur leurs propriétés reposent toutes les activités de la cellule, son architecture, son intégration. Les protéines agissent, non pas en formant des liaisons chimiques, mais en s'associant à d'autres composés. Leur structure leur confère en effet une vertu unique: celle de "reconnaitre " avec exactitude une ou plusieurs espèces chimiques seulement dans la mixture la plus hétérogène. La précision de ce choix, sa spécificité déterminent les relations qui s'établissent entre les constituants de la cellule. Elles en gouvernent toute la chimie.

Dans un système aussi complexe, seule la coordination des éléments donne une unité au système. Formée de quelques milliers d'espèce moléculaires, siège de quelques milliers de réaction chimiques qui se déroulent simultanément à toute vitesse, la cellule bactérienne ne peut former une totalité fonctionnelle sans une étroite cohésion de ses constituants. Tous les échanges de matière et d'énergie doivent être réglés dans le détail pour que puisse s'accomplir le dessein de la bactérie: produire deux bactéries. La petite cellule bactérienne ne saurait donc être une simple collection d'espèces moléculaires enfermées dans un sac et soumises aux lois statistiques qui régissent les éléments simplement juxtaposés et indépendants les uns des autres. Il faut un réseau de communication pour tenir informés les constituants qui se trouvent éloignés les uns des autres à l'échelle atomique et pour en commander les activités particulières en fonction de l'intérêt général et du but commun. A toutes les étapes de la chimie cellulaire interviennent des circuits de régulation pour coordonner les réactions et les ajuster aux exigences de la production. Moyennant une faible dépense d'énergie, la cellule adapte ainsi son travail à ses besoins. Elle ne produit que ce qu'il lui faut quand il lui faut. L'usine chimique est entièrement automatique.

Chaque système vivant relève alors de deux plans d'analyse, de deux coupes, l'une horizontale, l'autre verticale, qui ne peuvent être dissociées que pour la commodité de l'exposé. D'un coté, il s'agit de distinguer les principes qui régissent l'intégration des organismes, leur construction, leur fonctionnement ; de l'autre, ceux qui ont dirigé leurs transformations et leur succession. Décrire un système vivant, c'est se référer aussi bien à la logique de son organisation qu'à celle de son évolution. C'est aux algorithmes du monde vivant que s'intéresse aujourd'hui la biologie.

Commentaires et description du paradigme actuel

Quelles sont donc les composantes essentielles qui structurent ce paradigme ? Le lecteur me pardonnera ici les surinterprétations dont je suis seul responsable.

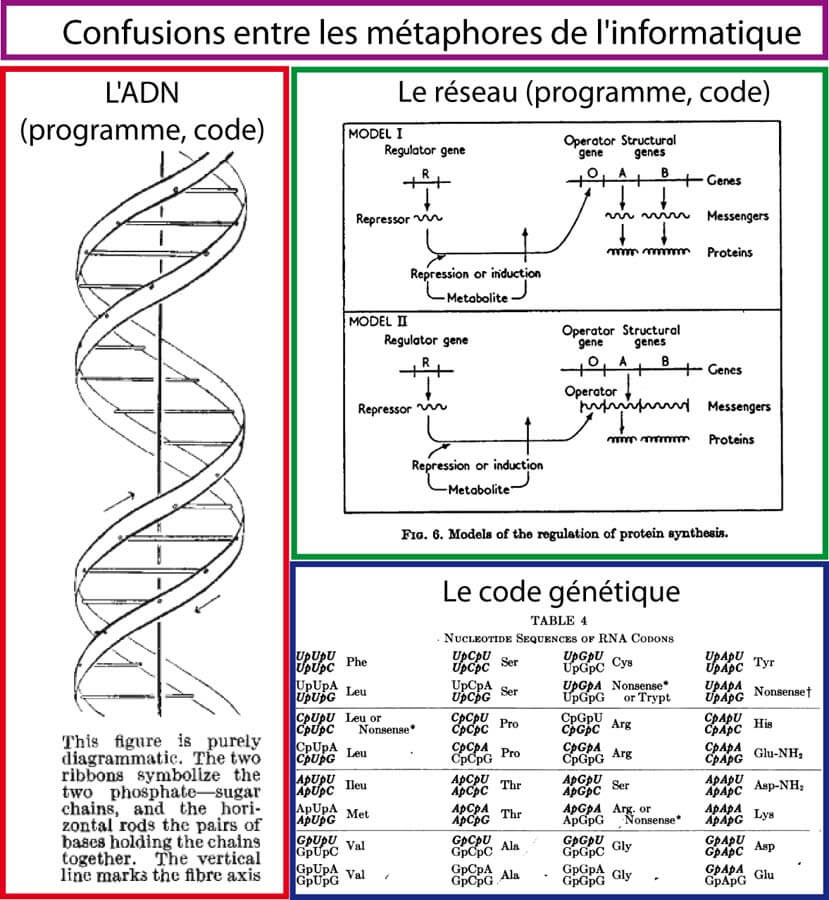

Le réseau, le programme et l'algorithme

Ce réseau complexe permet de coordonner l'action des milliers d'espèces moléculaires et de réactions chimiques et permet à la cellule d'être fonctionnelle. Contrairement à un réseau de neurones ou aux transistors, ce réseau est "virtuel ": les branches/flèches qui le composent représentent l'affinité qu'ont certains composés pour d'autres ce qui leurs permet de se réunir. Les fondements théoriques qui permettent l'existence de ce réseau dynamique sont donc: le rôle prépondérant de la liaison faible sur la liaison forte et le mouvement brownien des particules. Ce réseau est non linéaire, c'est-à-dire qu'il contient de nombreuses boucles de rétroaction qui rendent son comportement dynamique très difficile à déterminer avec l'intuition seule. De ce réseau émerge la vie de la bactérie.

Jacob et Monod ont démontré que certaines protéines peuvent contrôler l'expression des gènes. C'est l'exemple de l'operon lactose sur lequel je reviendrai. Si un gène code pour une protéine et qu'une protéine peut contrôler l'expression d'un gène alors un gène peut contrôler l'expression d'un autre gène. Ainsi le réseau est lui-même encodé dans le génome. Ce dernier contient donc deux types d'informations: le plan de toutes les protéines et le programme chargé d'adapter la concentration de chaque protéine en fonction de l'environnement extérieur.

On remarque d'emblée qu'une certaine confusion existe autour de la notion de programme et d'algorithme. Qui est le programme/l'algorithme ? Le réseau ? Ou la séquence du génome qui l'encode ? Pour le biologiste synthétique/des systèmes, le programme c'est le réseau. En effet, c'est le réseau qui est, en général, modélisé sous forme d'algorithme pour dévoiler son fonctionnement dynamique. A l'inverse, pour le biologiste théoricien, le programme, l'algorithme c'est la séquence du génome car, au final, il contient sous forme compressé (presque) toute l'information contenue dans le réseau.

L'autoreproduction, un but en soi ?

La bactérie possède la faculté d'autoreproduction/autoréplication. Levons l'ambigüité entre ces deux termes. Répliquer c'est faire une copie fidèle d'un objet. La photocopie d'un document ou la copie de la molécule d'ADN en deux molécules filles sont des exemples de processus de réplication. Par contre la reproduction sous-entend qu'un organisme autonome participe à la création ou crée un deuxième organisme lui aussi autonome. Le problème arrive quand on rajoute le préfixe "auto" qui implique l'autonomie. Qu'advient-il alors de la différence entre autoréplication et autoreproduction? Dans le cas d'une bactérie, il y a ambigüité car la cellule mère donne deux cellules filles totalement identiques (ce n'est pas tout à fait vrai) et donc les termes d'autoréplication et d'autoreproduction conviennent. Prenons maintenant le cas d'un organisme supérieur comme le Dragon de Komodo qui est capable de se reproduire par parthénogenèse (forme de reproduction asexuée). La femelle pond un oeuf. Même si cet oeuf a le même génome que sa mère, ce n'est pas la copie conforme de sa mère. Contrairement à l'autoréplication, l'autoreproduction peut inclure la remise en route, à partir d'un état initial, d'un programme qui conduit à l'état de parent.

François Jacob relève bien que le rêve de toute bactérie: c'est devenir deux bactéries. Il y aurait donc un projet, un but, un dessein mais cela rentre en contradiction avec la méthode scientifique qui refuse toute téléologie, toute finalité ---domaine réservé à la métaphysique---. Pour trouver un terrain d'entente provisoire, Jacques Monod introduit le terme de "téléonomie ", concept scientifique de finalité. Cependant, la profondeur de cette contradiction épistémologique ne lui échappe pas. J'y reviendrai dans le chapitre sur l'épistémologie.

Quel est le coût énergétique d'un calcul/changement d'état du réseau?

Les deux auteurs ont bien remarqué que se pose la question du coût thermodynamique du calcul effectué par la cellule lors de son adaptation à un changement de milieu. Jacques Monod nous parle de gratuité chimique des interactions allostériques (une molécule en se fixant à une deuxième modifie sa forme et sa fonction). A l'inverse, François Jacob nous explique que l'adaptation de la cellule se fait moyennant une faible dépense d'énergie.

Il semble apparemment possible qu'une cascade de changements allostériques dans la cellule suite à un changement dans le milieu puisse avoir un coût énergétique nul (Excepté bien sûr le coût thermodynamique minimum). A l'inverse, d'autres types de changements comme par exemple une modification d'expression génique nécessite une grande consommation d'ATP et donc d'énergie.

Mais il y a une autre question controversée, plus difficile et plus profonde, qui se pose à la physique: le coût thermodynamique minimum qu'entrainent la manipulation et le stockage de l'information. Il semblerait possible, d'un point de vue théorique, de faire un calcul (ou de mesurer une information) sans consommation d'énergie. Et ce serait plutôt l'effacement de la mémoire qui aurait un coût thermodynamique. Et il n'est pas impossible que ces questions théoriques puissent s'appliquer à la manière dont une cellule gère l'information.

Jacques Monod remarque aussi qu'une part de l'information ne vient pas du génome mais du milieu qui fournit des conditions initiales bien définies (température, composition ionique, phase aqueuse). Nous reviendrons sur ce concept d'information, y compris sur celle apportée par le milieu.

Temps, évolution et adaptation

Nous avons vu que le transfert de l'information génétique est à sens unique. Autrement dit, les protéines ne codent pas pour les gènes. En revanche, lorsque les conditions extérieures changent, certaines protéines vont détecter la modification puis modifier, directement ou indirectement, l'expression de certains gènes de manière à réadapter la concentration de certaines protéines aux nouvelles conditions. La bactérie s'adapte à son environnement. Autrement dit, l'environnement ne peut pas changer la séquence du génome (le texte) mais peut changer son expression (lire certaines pages et pas d'autres). D'une certaine manière, le contenu cellulaire, une fois l'adaptation terminée, reflète en miroir le milieu extérieur. On peut imaginer qu'en connaissant le contenu cellulaire, on puisse inférer certaines caractéristiques de l'environnement extérieur et réciproquement. Nous pourrions donc potentiellement répondre à une question dynamique: y'a-t-il du glucose dans le milieu maintenant, là ? S'il y a un grand nombre de transporteurs du glucose dans la cellule, cela pourrait signifier qu'il y a du glucose dans le milieu.

Mais comment le plan (le génome) change t'il ? Le plan change grâce aux effets de l'évolution, au couple sélection--mutation. Lorsque la bactérie recopie son génome, elle introduit des erreurs de manière strictement aléatoire. Les mutations qui confèrent un avantage aux bactéries sont sélectionnées. Au fil du temps évolutif (qui se mesure en générations), le génome est donc modelé. La connaissance de sa séquence nous permet potentiellement de répondre à une question plus statique: sais-tu ce qu'est le glucose ? Si le génome contient un gène codant pour un transporteur du glucose, alors la bactérie "sait " quand et comment utiliser le glucose même si elle n'en a jamais rencontré. Cela reflète aussi l'environnement à long terme. Le maintien, au cours de l'évolution, du gène du transporteur signifie que le glucose est une source de carbone courante et connue des générations précédentes qui l'ont souvent rencontrée. Si on découvrait une bactérie conservée dans la glace, ayant vécu il y a 1 milliard d'années, l'étude de ses gènes et de la fonction des protéines correspondantes pourrait nous donner des indications sur l'environnement extérieur de l'époque. C'est en cela que l'on peut potentiellement "remonter dans le temps". Cependant l'arbre évolutif n'avance à travers le temps que dans un sens. Tout comme avec le 2ème principe de la thermodynamique, il y a une irréversibilité qui fait que l'on ne pourra jamais reconstituer l'arbre phylogénétique réel tel qu'il s'est construit c'est-à-dire incluant tous les organismes disparus sans laisser de trace.

Je souhaite nuancer ici l'idée que l'environnement ne peut en aucun cas changer la séquence du génome. En effet, l'environnement intestinal, où vit E. coli, a évidement largement contribué à modeler son génome mais cela passe nécessairement par la sélection naturelle. On peut dire que l'organisme choisit et façonne le milieu et, réciproquement, le milieu choisit et façonne l'organisme.

E. coli au 21ème siècle

On voit à travers ce rappel historique comment les images de la vie et d'une bactérie comme E. coli ont évolué au cours du temps. Après "l'étincelle vitale" dont étaient affublés les êtres vivants, les progrès en chimie ont montré que ces derniers étaient composés des mêmes atomes que la matière inerte. La différence tenait dans l'existence de petits catalyseurs complexes capable de catalyser des réactions chimiques extrêmement difficiles à réaliser en laboratoire. L'influence de la thermodynamique faisait des bactéries des fours capables de transformer les molécules organiques en chaleur. Puis émerge dans les années 50--60 une nouvelle branche de la biologie: la biologie moléculaire, très largement influencée par des physiciens comme Erwin Schrödinger ou Max Delbrück. Le code génétique, le programme cordonné et le réseau de régulation font entrevoir la vie sous le prisme de l'information. Les analogies entre les ordinateurs et la vie sont si fortes que les biologistes ne veulent plus comprendre la "vie" mais "les algorithmes du monde vivant ". Comme le dit Bernd-Olaf Küppers, la vie est matière plus information. Le paradigme ou le dogme toujours en vigueur aujourd'hui est posé: la vie émerge d'un réseau de régulation complexe créé principalement par les interactions faibles entre différentes espèces moléculaires. Même si une part d'information vient du milieu, le réseau de régulation et les espèces moléculaires (la plupart) sont encodés dans le génome qui, lui, est modelé par l'évolution. En plus de partager les mêmes atomes, les êtres vivants partagent des molécules communes (ADN, ARN, protéines), un set commun de réactions enzymatiques très proches et un code génétique universel. Ce qui les distingue c'est la taille et la séquence de leur génome.

Après que le paradigme ait été bien posé sur ses bases, 40 ans de recherche en biologie moléculaire et en biochimie ont suivi, permettant une description de plus en plus précise des mécanismes moléculaires gouvernant le fonctionnement d'une bactérie comme E. coli. Cette dernière est aujourd'hui l'organisme vivant le plus facile à manipuler et dont le fonctionnement est le mieux décrit. On compte, à la fin du 20ème siècle, plus de 100 000 publications scientifiques sur E. coli. En 1997, le séquençage complet du génome d'E. coli est achevé (Blattner et al. 1997). Tous ces éléments offrent alors le terreau favorable à l'émergence, au début du 21ème siècle, de deux disciplines jumelles: la biologie des systèmes et la biologie synthétique. Ces deux disciplines font le constat que les méthodes et techniques de la biologie ne permettront pas d'expliquer la dynamique de fonctionnement d'un système vivant à partir de la simple compréhension des briques de base. La biologie se heurte à ce que les mathématiciens, physiciens et informaticiens connaissent déjà bien: la complexité. L'interdisciplinarité devient de plus en plus évidente, voire même indispensable. D'ailleurs, selon Hervé Zwirn, on peut "voir les sciences de la complexité comme la première avancée vers un affaiblissement progressif de l'importance des frontières disciplinaires " 11 . Cette interdisciplinarité change petit à petit le regard porté sur E. coli. Ainsi:

- Pour un biologiste "classique" : E. coli est une bactérie intestinale, potentiellement pathogène. Son étude permet de décrypter beaucoup des mécanismes moléculaires présents ou non chez d'autres espèces ou même d'étudier les processus évolutifs. La découverte d'une nouvelle fonction (protéine), d'une nouvelle régulation (interaction), d'une nouvelle cible d'antibiotique ou de nouveaux mécanismes "entièrement nouveaux" tel le rôle des petits ARN sont les objectifs de ce biologiste à plus ou moins long terme. Ses outils sont les techniques de la biologie moléculaire, de la génétique, de la microbiologie et de la biochimie.

- Pour un biologiste des systèmes/synthétique: E. coli est une entité autonome, auto réplicative, capable de calcul et donc de traitement de l'information. L'intérêt d'E. coli c'est qu'il s'agit d'une boite noire mais c'est la moins noire des boites noires vivantes. Le biologiste espère, par exemple, contrôler de plus en plus "d'input " et "d'output " différents pour essayer, par ingénierie inverse, d'élucider son fonctionnement dynamique. En effet, il pense que son réseau de régulation non linéaire est un modèle idéal pour étudier la complexité. Il souhaite démontrer que l'hypothèse "la vie émerge du fonctionnement du réseau de régulation" est un fait scientifique "poppérien " et non une idéologie. Pour cela, il veut contrôler le réseau avec de plus en plus de précision, tirer les ficelles pour décider du phénotype. Citons le bon mot (traduit en français) du prix Nobel Hamilton Smith, quand un journaliste lui demande s'il a l'impression de jouer à dieu: sa réponse: "on ne joue pas " (rire). Si la recherche fait une percée conséquente dans les décennies à venir sur la question de la complexité chez les êtres vivants, les conséquences pour la civilisation humaine peuvent être gigantesques, plus grosses encore que l'arrivée d'internet ou du transistor. Le but du biologiste des systèmes/synthétique: participer à cette révolution. Ces outils sont ceux du biologiste classique ainsi que ceux des mathématiciens, physiciens, informaticiens et ingénieurs. Peut-être plus que les outils, c'est le mode de pensée de ces disciplines que ce biologiste doit acquérir. La double casquette lui permet d'entrevoir les problèmes sous des angles différents.

Arrivé au terme de notre périple historique, je souhaite terminer ce chapitre en énumérant les différents types d'explications que l'on trouve en biologie au 21ème siècle. En effet, si les modes et les biologistes changent, les principes d'intelligibilité perdurent (même s'ils ne sont ni eternels ni immuables). Selon Michel Morange, pour expliquer les phénomènes biologiques (par exemple une fonction donnée), les scientifiques se réfèrent aujourd'hui à 3 schèmes explicatifs 12:

- Les explications de type molécularo-mécaniste: elles consistent en l'établissement d'une chaine de causalité, où chaque maillon correspond à une interaction entre une ou quelques molécules.

- Les explications de type darwinien: une caractéristique (fonction, forme, comportements...) peut être observée parce qu'elle apporte aux individus, directement ou indirectement, une probabilité plus grande de laisser des descendants.

- Les explications de type physique non causal: elles reposent sur l'existence de relations et de contraintes atemporelles. Par exemple, la capside des virus repose sur des lois géométriques simples. Un exemple que l'on doit à René Thom: décrire de manière intelligible la mécanique de locomotion d'un chat ne nécessite pas de descendre aux niveaux des interactions moléculaires 13. Un autre exemple amusant dont je ne retrouve pas l'auteur: quand un poisson volant sort de l'eau puis finit par retomber dans l'eau: ni Darwin ni le "réseau" du poisson ne sont des schèmes explicatifs appropriés pour décrire la retombée. Les lois de la gravitation sont bien plus adéquates. Un dernier exemple est la structure hexagonale des alvéoles d'abeille qui minimise la quantité de cire nécessaire au pavage du plan et correspond donc à la solution la plus économique. Cet exemple que j'ai trouvé dans un ouvrage de Jean-louis Le Moigne me permet de montrer ce qui n'est pas un principe d'intelligibilité: le principe de moindre action, purement idéologique, qui permettrait d'expliquer tout phénomène dés lors que l'on connait la fonction à optimiser 14.

Bibliographie

-

Avery, O. T., C. M. Macleod, et al. (1944). "Studies on the Chemical Nature of the Substance Inducing Transformation of Pneumococcal Types : Induction of Transformation by a Desoxyribonucleic Acid Fraction Isolated from Pneumococcus Type Iii." J Exp Med 79(2): 137-158.

-

Beadle, G. W. and E. L. Tatum (1941). "Genetic Control of Biochemical Reactions in Neurospora." Proc Natl Acad Sci U S A 27(11): 499-506.

-

Blattner, F. R., G. Plunkett, 3rd, et al. (1997). "The complete genome sequence of Escherichia coli K-12." Science 277(5331): 1453-62.

-

Hershey, A. D. and M. Chase (1952). "Independent functions of viral protein and nucleic acid in growth of bacteriophage." J Gen Physiol 36(1): 39-56.

-

Jacob, F. and J. Monod (1961). "Genetic regulatory mechanisms in the synthesis of proteins." J Mol Biol 3: 318-56.

-

Meselson, M. and F. W. Stahl (1958). "The Replication of DNA in Escherichia Coli." Proc Natl Acad Sci U S A 44(7): 671-82.

-

Nirenberg, M., P. Leder, et al. (1965). "RNA codewords and protein synthesis, VII. On the general nature of the RNA code." Proc Natl Acad Sci U S A 53(5): 1161-8.

-

Nirenberg, M. W. and J. H. Matthaei (1961). "The dependence of cell-free protein synthesis in E. coli upon naturally occurring or synthetic polyribonucleotides." Proc Natl Acad Sci U S A 47: 1588-602.

-

Tatum, E. L. and J. Lederberg (1947). "Gene Recombination in the Bacterium Escherichia coli." J Bacteriol 53(6): 673-84.

-

Watson, J. D. and F. H. Crick (1953). "Molecular structure of nucleic acids; a structure for deoxyribose nucleic acid." Nature 171(4356): 737-8.

Notes de bas de page

- Carl Sagan, Definitions of life

- Georges Canguilhem, La connaissance de la vie, bibliothèque des textes philosophiques, p. 170.

- François Jacob, La logique du vivant, Gallimard, p. 205

- Les deux images à droite sont des images issues de Wikipedia.

- Plusieurs paragraphes dans ce chapitre dont celui-ci sont inspirés du très pédagogique livre de Carl Zimmer, microcosm. Les qualités littéraires de l’auteur rendent la lecture de cet ouvrage (sur la vie d’E. coli) très accessible à un public non expert.

- Cependant, Antoine Danchin met en évidence que Erwin Schrödinger fait une confusion entre l’ordre créé dans la cellule et l’augmentation de l’entropie qui ne correspond pas, comme on le lit souvent, à une augmentation de désordre. (Antoine Danchin, La barque de Delphes, Odile Jacob, p. 119)

- Erwin Schrödinger, Qu’est ce que la vie ?, Points, P.114, 116, 139

- Jacques Monod, Le hasard et la nécessité, Point, p. 126, 128

- François Jacob, La logique du vivant, Gallimard, p.284, 287

- Jacques Monod, Le hasard et la nécessité, Point, p. 198

- Hervé Zwirn, Les systèmes complexes, Odile Jacob, p. 211

- Michel Morange, Les secrets du vivant, La découverte

- René Thom, Prédire n’est pas expliquer, Flammarion, p. 123.

- Jean-Louis Le Moigne, Les épistémologies constructivistes, PUF, p. 36.